Cours

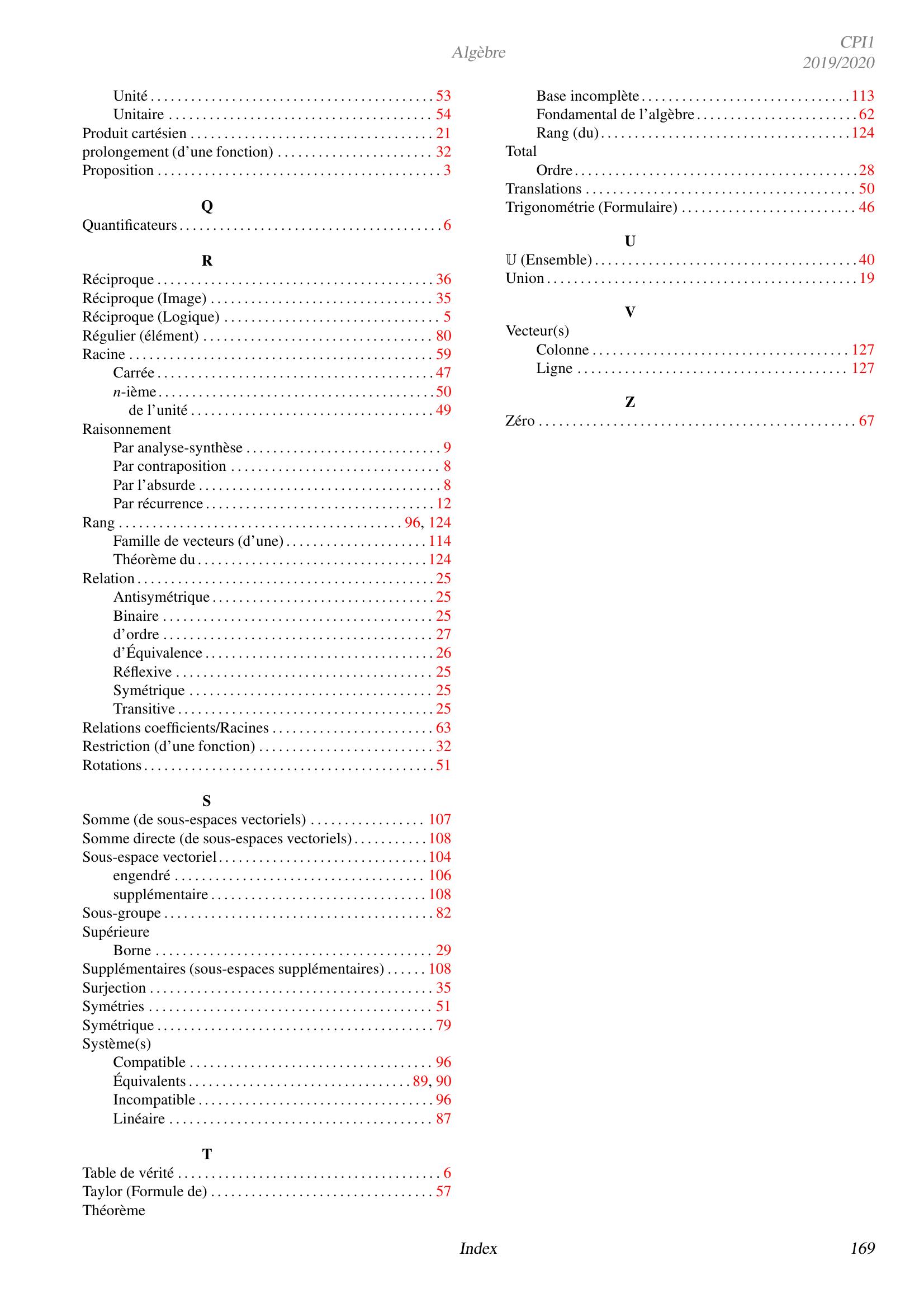

Pages : 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 53 54 55 56 57 58 59 60 61 62 63 64 65 66 67 68 69 70 71 72 73 74 75 76 77 78 79 80 81 82 83 84 85 86 87 88 89 90 91 92 93 94 95 96 97 98 99 100 101 102 103 104 105 106 107 108 109 110 111 112 113 114 115 116 117 118 119 120 121 122 123 124 125 126 127 128 129 130 131 132 133 134 135 136 137 138 139 140 141 142 143 144 145 146 147 148 149 150 151 152 153 154 155 156 157 158 159 160 161 162 163 164 165 166 167 168 169 170 171 172 173 174 175 176 177 178 179 180

Page 1 : CPI1AlgèbreCoursjean-michel.masereel@eisti.eu

Page 2 :

Page 3 : La vie n’est bonne qu’à deux choses :Découvrir les mathématiques et enseigner les mathématiques.Siméon Denis Poisson 1781 - 1840

Page 4 :

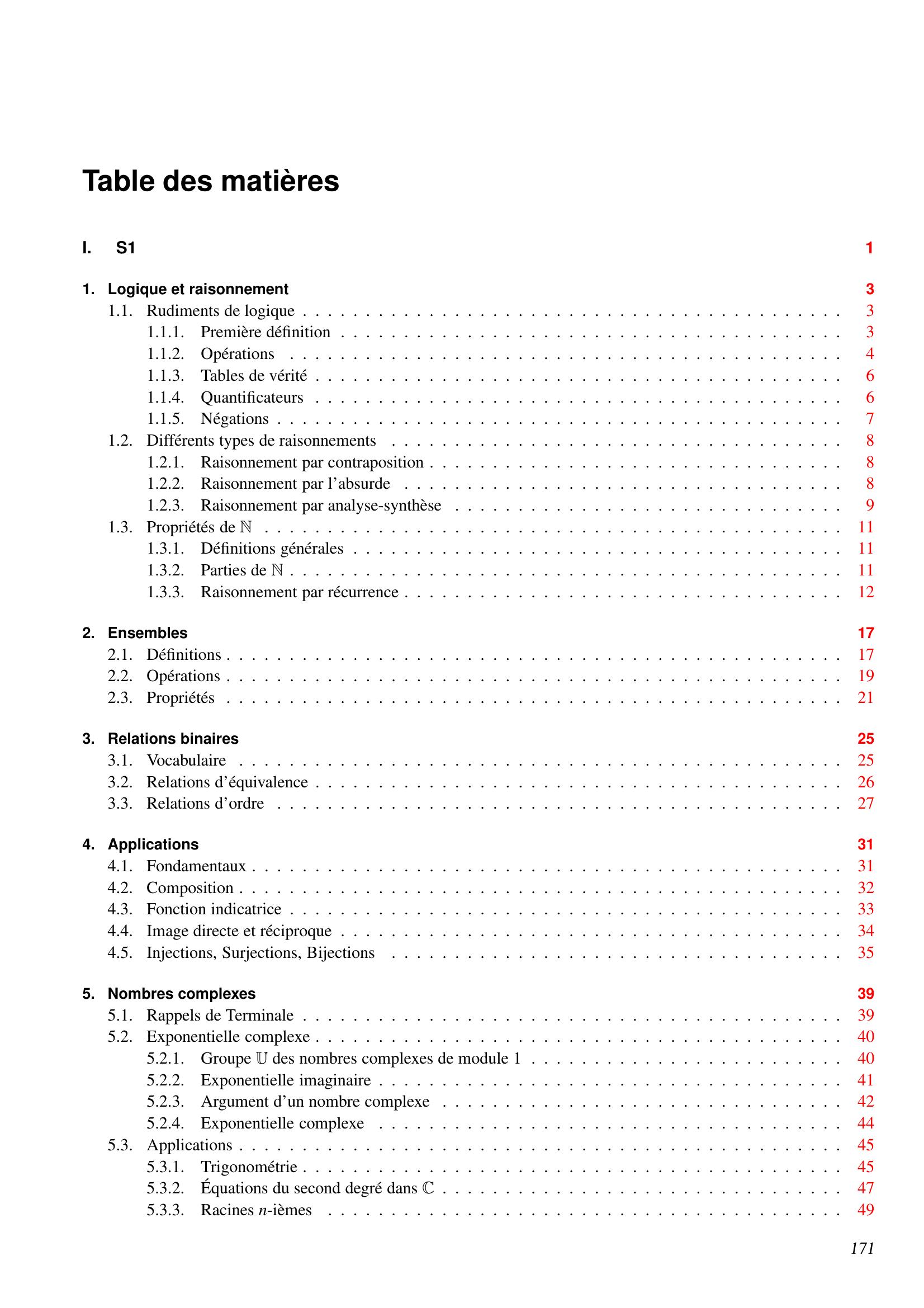

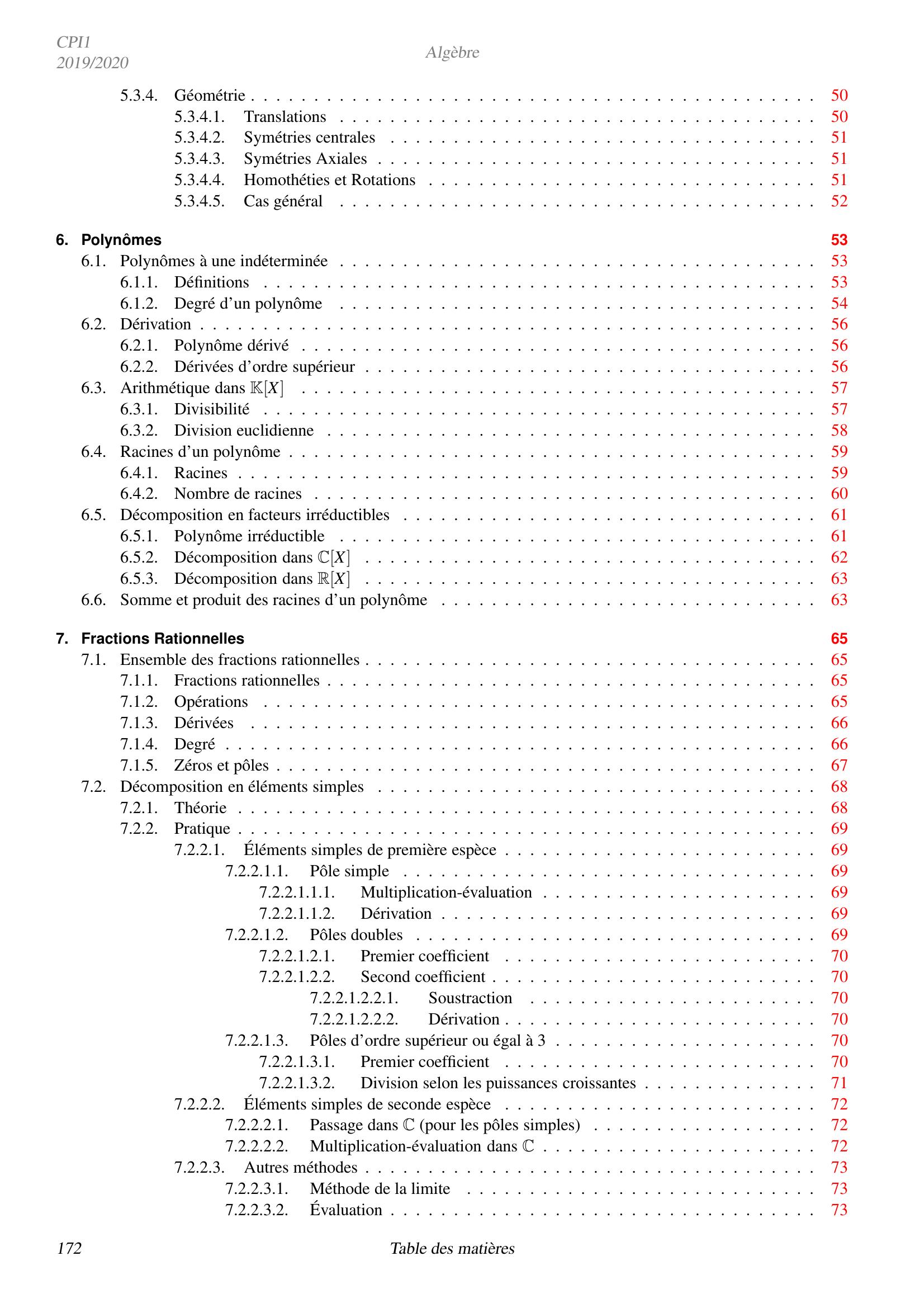

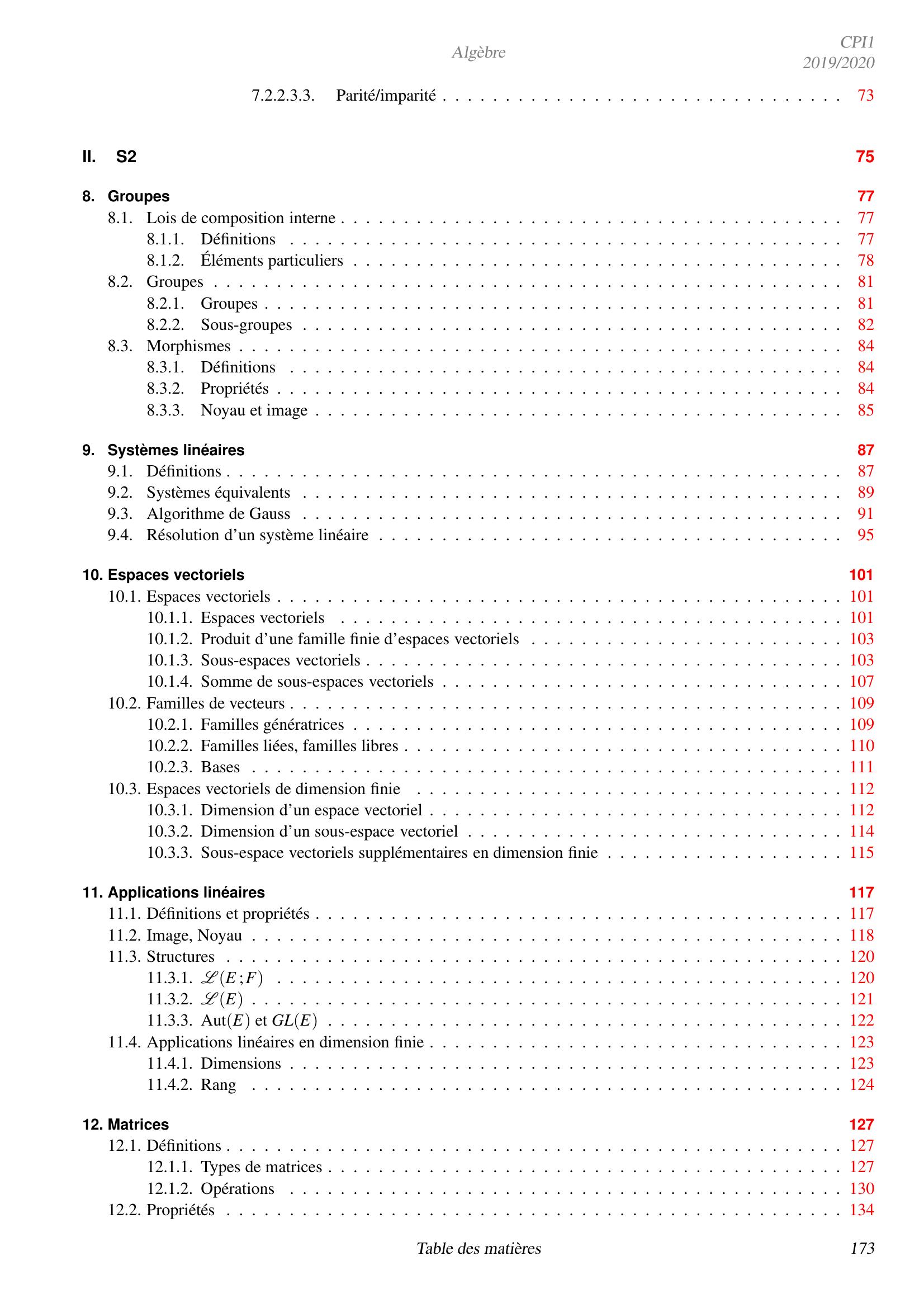

Page 5 : SommaireI.S111.Logique et raisonnement31.1.Rudiments de logique . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .31.2.Différents types de raisonnements. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .81.3.Propriétés de N . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .112.Ensembles172.1.Définitions . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .172.2.Opérations . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .192.3.Propriétés . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .213.Relations binaires253.1.Vocabulaire . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .253.2.Relations d’équivalence . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .263.3.Relations d’ordre . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .274.Applications314.1.Fondamentaux . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .314.2.Composition . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .324.3.Fonction indicatrice . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .334.4.Image directe et réciproque . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .344.5.Injections, Surjections, Bijections. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .355.Nombres complexes395.1.Rappels de Terminale . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .395.2.Exponentielle complexe . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .405.3.Applications . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .456.Polynômes536.1.Polynômes à une indéterminée . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .536.2.Dérivation . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .566.3.Arithmétique dans KX. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .576.4.Racines d’un polynôme . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .596.5.Décomposition en facteurs irréductibles . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .616.6.Somme et produit des racines d’un polynôme. . . . . . . . . . . . . . . . . . . . . . . . . . . . . .637.Fractions Rationnelles657.1.Ensemble des fractions rationnelles . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .657.2.Décomposition en éléments simples . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .68II.S2758.Groupes778.1.Lois de composition interne . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .778.2.Groupes . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .818.3.Morphismes . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .84iii

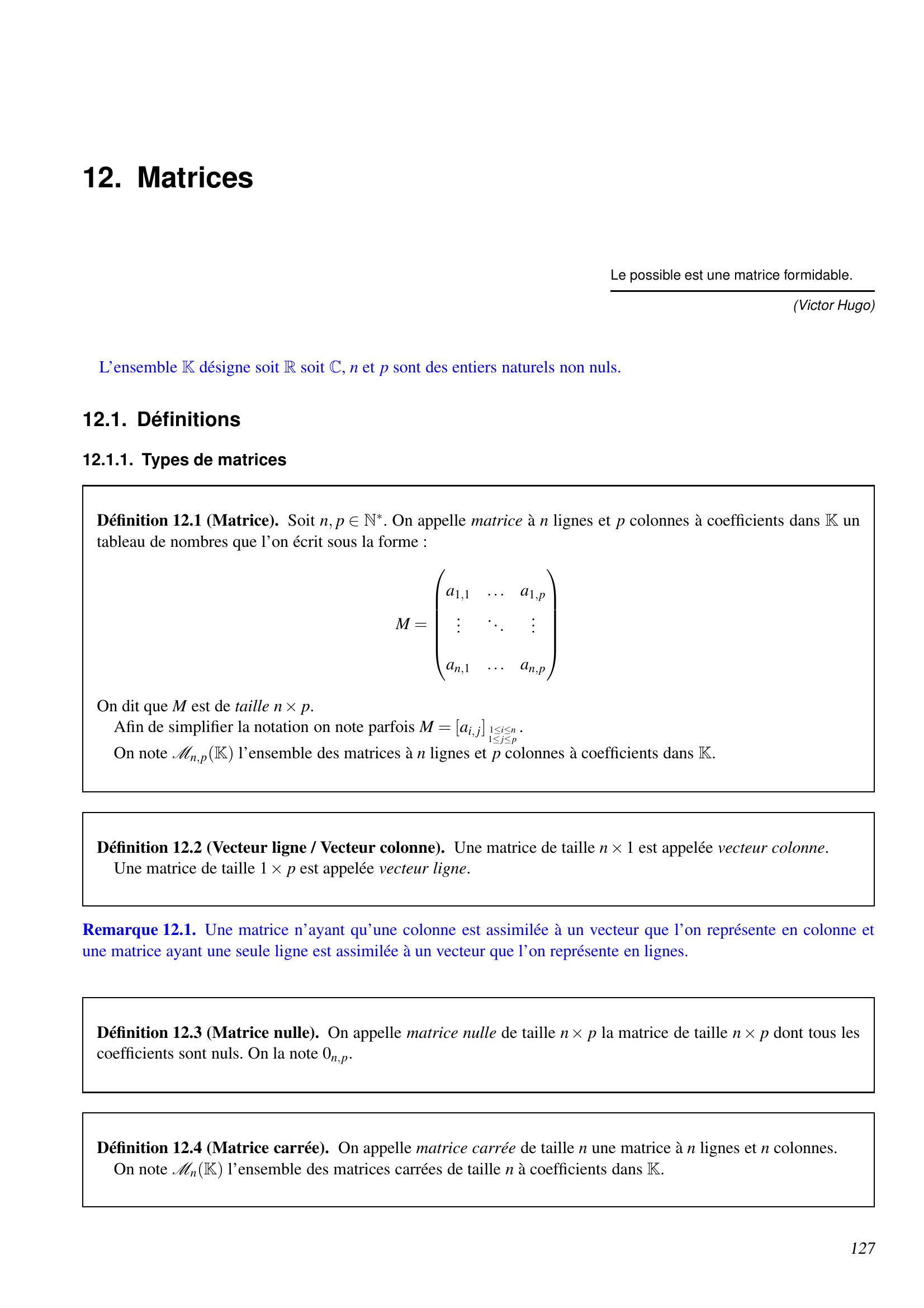

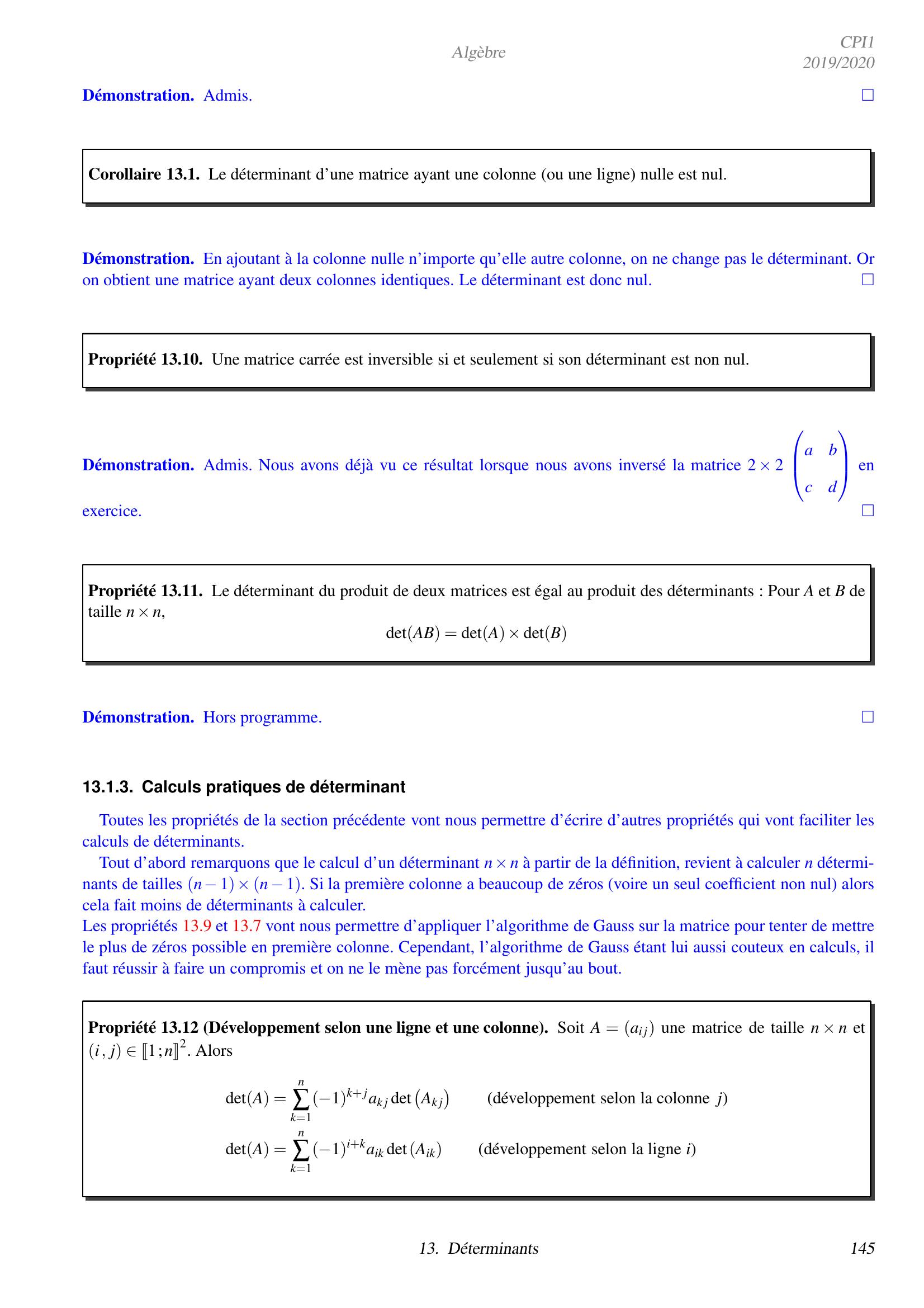

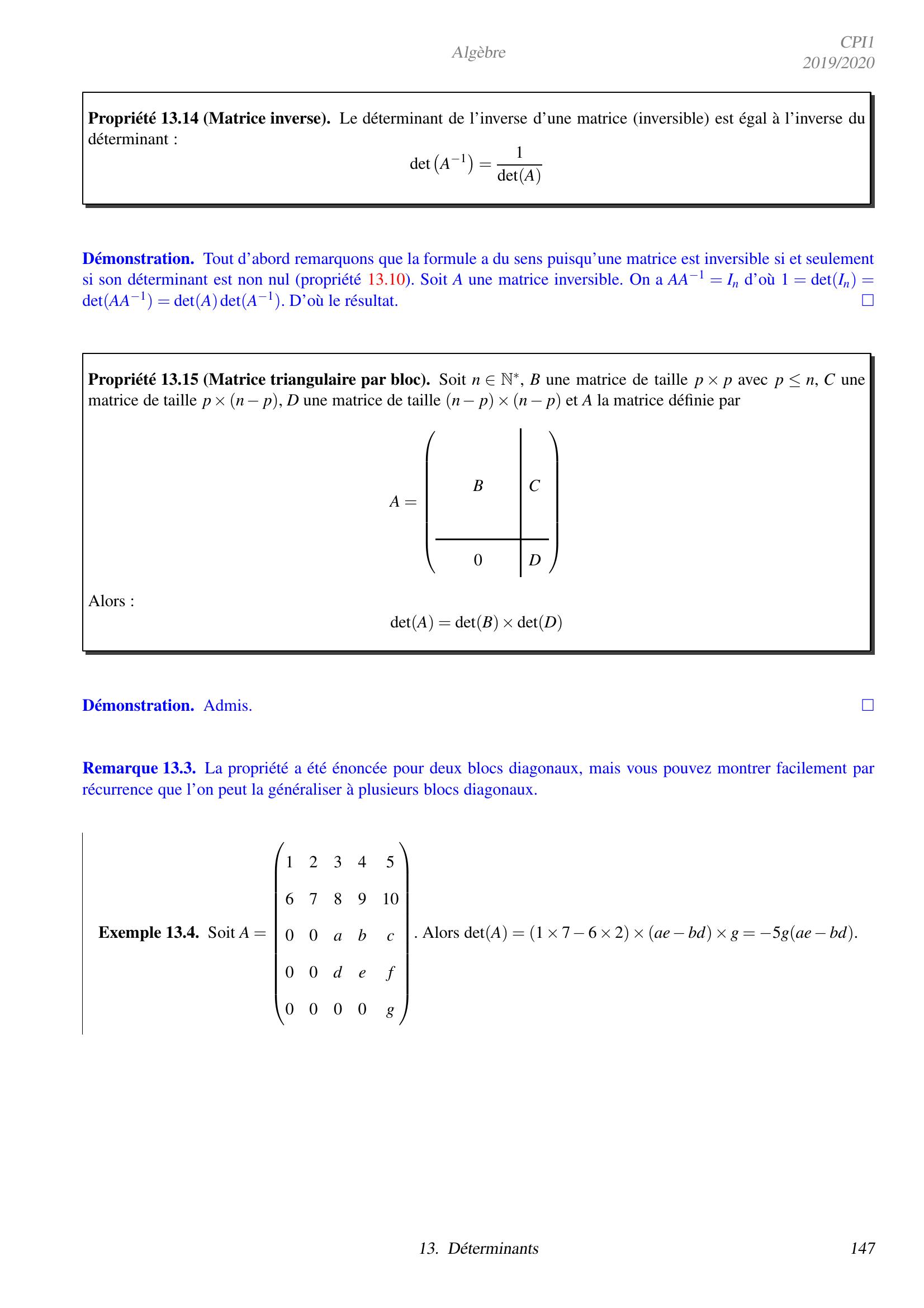

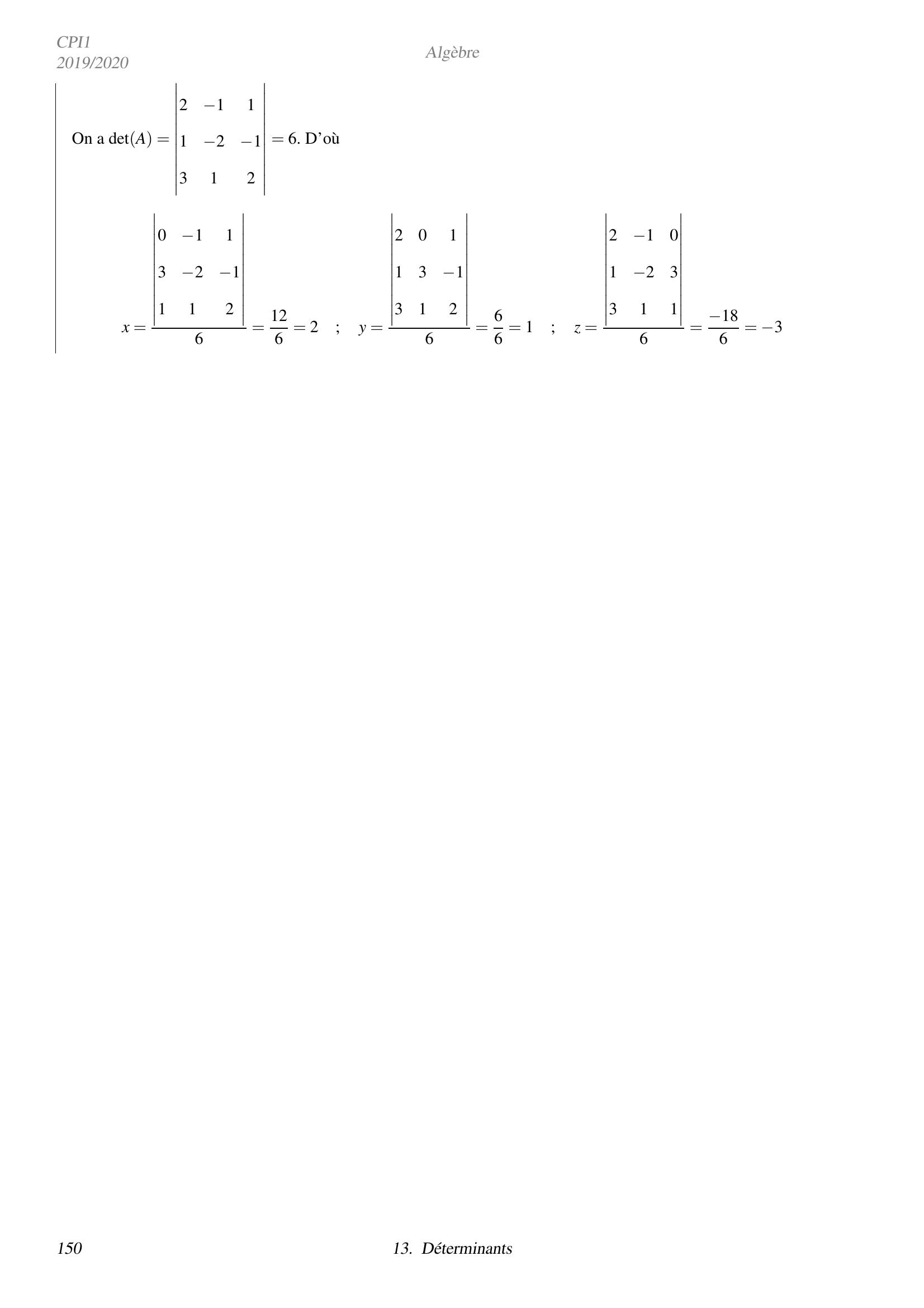

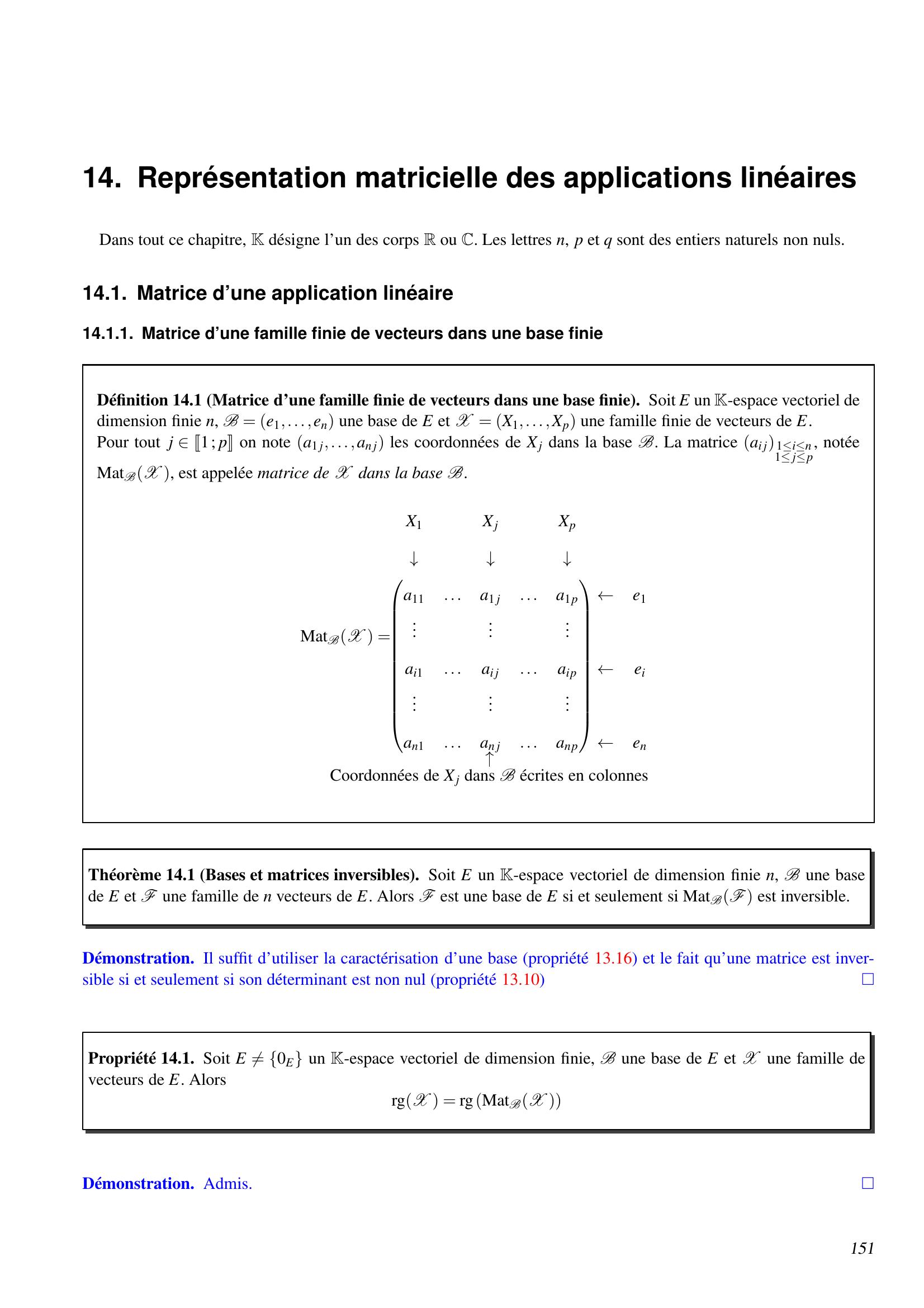

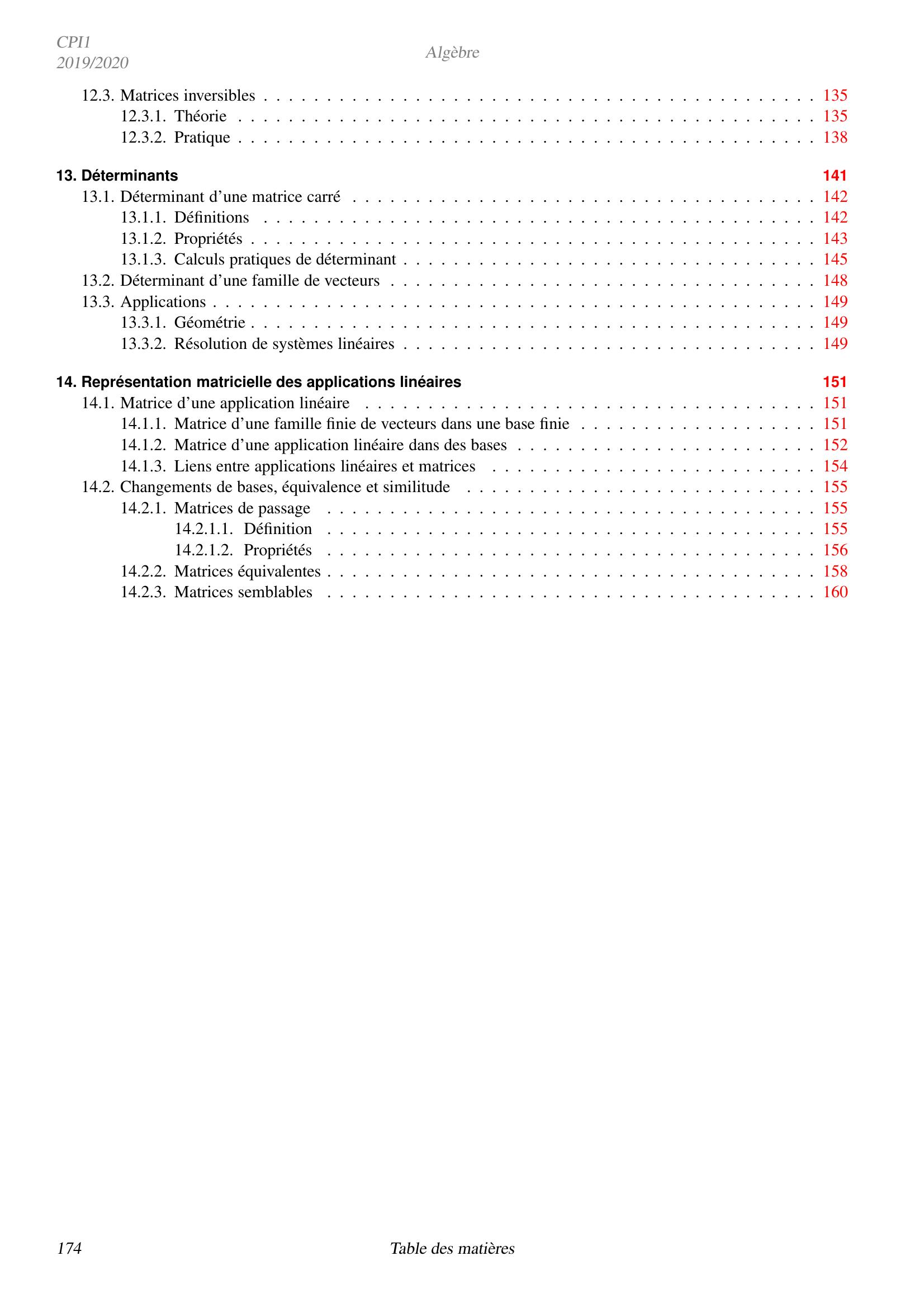

Page 6 : CPI12019/2020Algèbre9.Systèmes linéaires879.1.Définitions . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .879.2.Systèmes équivalents . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .899.3.Algorithme de Gauss . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .919.4.Résolution d’un système linéaire . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .9510. Espaces vectoriels10110.1. Espaces vectoriels . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 10110.2. Familles de vecteurs . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 10910.3. Espaces vectoriels de dimension finie. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 11211. Applications linéaires11711.1. Définitions et propriétés . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 11711.2. Image, Noyau . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 11811.3. Structures . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 12011.4. Applications linéaires en dimension finie . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 12312. Matrices12712.1. Définitions . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 12712.2. Propriétés . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 13412.3. Matrices inversibles . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 13513. Déterminants14113.1. Déterminant d’une matrice carré . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 14213.2. Déterminant d’une famille de vecteurs . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 14813.3. Applications . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 14914. Représentation matricielle des applications linéaires15114.1. Matrice d’une application linéaire. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 15114.2. Changements de bases, équivalence et similitude. . . . . . . . . . . . . . . . . . . . . . . . . . . . 155ivSOMMAIRE

Page 7 : Première partieS11

Page 8 :

Page 9 : 1. Logique et raisonnementTous les hommes sont mortels, or Socrateest un homme donc Socrate est mortel.Aristote.Autre syllogisme : tous les chats sontmortels. Socrate est mortel. Donc Socrateest un chat.Le logicien, dans Le rhinocéros, E.Ionesco.Ce chapitre a pour objectif de vous apprendre à raisonner correctement, c’est-à-dire pas comme le logicien deIonesco. Vous utilisez déjà, peut-être sans le savoir, le syllogisme formalisé par Aristote. En effet, vous avez déjàl’habitude de démontrer qu’une implication « P ⇒Q » est vraie, puis de vérifier que la proposition P est vraie pouren déduire que la proposition Q est vraie.Nous allons voir dans ce chapitre d’autres types de raisonnements.1.1. Rudiments de logique1.1.1. Première définitionDéfinition 1.1 Proposition. On appelle proposition un énoncé mathématiques qui peut être soit vrai noté Vou 1 soit faux noté F ou 0.Les énoncés ne sont pas forcément mathématiques. Durant votre parcours à l’EISTI, nous ne nous intéresseronsqu’aux énoncés mathématiques et physique, même si, pour expliquer un concept, nous pourrons utiliser des exemplesissus d’autres disciplines.Exemple 1.1.— « 1+1=2 » est une proposition vraie.— « L’entier 2014 est impair » est une proposition fausse.— « Tous les élèves de la classe auront leur diplôme d’ici 5 ans ». Nous ne pouvons pas encore déterminer sicet énoncé est vrai ou faux, il reste néanmoins soit vrai soit faux, c’est donc bien une proposition.— « Quelle heure est-il? » est un énoncé, mais il n’a pas de valeurs de vérité : ce n’est ni vrai ni faux. Ce n’estdonc pas une proposition.3

Page 10 : CPI12019/2020Algèbre1.1.2. OpérationsÀ partir d’une ou plusieurs propositions, il est possible d’en créer de nouvelles.Définition 1.2 Négation. Soit une proposition P. On définit la négation de P que l’on note « ¬P » ou « P » ouencore « nonP », comme la proposition qui est vraie lorsque P est fausse et est fausse lorsque P est vraie.Remarque 1.1. Les deux propositions P et P ne peuvent pas être vraies en même temps.Exemple 1.2. Soit P la proposition « Il fait plus de 20 ◦C aujourd’hui ». La négation de P est « Il fait moins de20 ◦C aujourd’hui ». Il ne peut pas faire à la fois plus de 20 ◦C et moins de 20 ◦C.Définition 1.3 Conjonction. Soit deux propositions P et Q. On définit la conjonction de P et Q que l’on note« PQ » ou « P et Q », comme la proposition qui est vraie lorsque P et Q sont toutes les deux vraies, et fausselorsque au moins l’une des deux propositions P ou Q est fausse.Exemple 1.3. Soit P la proposition « Il fait plus de 20 ◦C aujourd’hui » et Q la proposition « Il va pleuvoirdemain ». La conjonction de P et Q est « Il fait plus de 20 ◦C aujourd’hui et il va pleuvoir demain ».Définition 1.4 Disjonction. Soit deux propositions P et Q. On définit la disjonction de P et Q que l’on note« PQ » ou « P ou Q », comme la proposition qui est vraie lorsque au moins l’une des deux propositions P ouQ est vraie, et fausse lorsque les deux propositions P et Q sont fausses.Exemple 1.4. Soit P la proposition « Il fait plus de 20 ◦C aujourd’hui » et Q la proposition « Il va pleuvoirdemain ». La disjonction de P et Q est « Il fait plus de 20 ◦C aujourd’hui ou il va pleuvoir demain ».Remarque 1.2. Attention, le « ou » mathématiques n’a pas exactement le même sens que le « ou » français. En effet,le « ou » mathématique est non exclusif, c’est-à-dire que l’on n’interdit pas à P et Q d’être vrais tous les deux. Enfrançais, le « ou » est plutôt considéré comme exclusif. Lorsque dans un restaurant par exemple, il est écrit sur la carte« fromage ou dessert », il ne viendrait à l’idée de personne sauf peut-être d’un prof de maths de commander les deux.Dans les définitions précédentes, il n’y avait pas de lien entre les deux propositions P et Q. Nous allons voirmaintenant des opérations qui sous tendent un lien entre P et Q.Définition 1.5 Implication. Soit P et Q deux propositions. On définit la proposition P implique Q, notée P ⇒Q,comme la proposition qui est vraie si P est fausse ou si P et Q sont toutes les deux vraies; et qui est fausse si Pest vraie et Q fausse.Exemple 1.5.— Soit P la proposition « je ne me suis pas réveillé ce matin » et Q la proposition « je suis enretard à l’école ». La proposition P ⇒Q est vraie. Remarquez que la proposition Q ⇒P est fausse.— La proposition 1 = 2 ⇒π = e est-elle vraie ou fausse?41. Logique et raisonnement

Page 11 : AlgèbreCPI12019/2020Définition 1.6 Réciproque. Soit P et Q deux propositions. La réciproque de la proposition « P ⇒Q » est laproposition « Q ⇒P »Tout comme nous l’avons vu sur l’exemple précédent, connaître la valeur de vérité de P ⇒Q ne donne aucuneinformation sur la valeur de vérité de Q ⇒P.Définition 1.7 Équivalence. Soit P et Q deux propositions. On définit la proposition P équivalent à Q, notéeP ⇔Q, comme la proposition qui est vraie si P et Q sont vraies ou si P et Q sont fausses; et qui est fausse si l’uneest fausse et l’autre vraie.Remarque 1.3. On démontrera en TD que la proposition P ⇔Q a la même valeur de vérité que P ⇒Q et Q ⇒P. Cela donne une certaine cohérence dans les notations ⇒et ⇔.Exemple 1.6.— Il semble difficile de trouver un exemple de la vie courante. Et vous? Réussirez-vous à enproposer une?— Soit a et b deux réels. L’équivalence a = b ⇔ea = eb est vraie.— La proposition 1 = 2 ⇔32 = 9 est elle vraie ou fausse?Attention de ne pas confondre l’implication et l’équivalence, ce que vous faites souvent. Lorsque l’on rédige unedémonstration il est plus naturel de raisonner en implication. Or on a plus souvent besoin d’avoir des équivalences.Lorsque l’on écrit une équivalence, il faut donc toujours penser à vérifier que la réciproque est bien vraie.Définition 1.8 Condition nécessaire/suffisante.— Soit P ⇒Q une implication. On dit que P est une condition suffisante à Q, et que Q est une conditionnécessaire à P.— Soit P ⇔Q une équivalence. On dit que P est une condition nécessaire et suffisante à Q ou que Q est unecondition nécessaire et suffisante à P.Remarque 1.4. Supposons que P ⇒Q.— Le fait que P soit vraie suffit à ce que Q soit vraie.— Par contre le fait que P soit vraie n’est pas nécessaire à Q puisque Q peut très bien être vraie alors que P ne l’estpas.— Lorsque P est vraie, Q est nécessairement vraie aussi.— Le fait que Q soit vraie ne suffit pas à ce que P soit vraie puisque, comme nous l’avons déjà signalé, Q peut trèsbien être vraie alors que P ne l’est pas.Remarque 1.5. Lorsque P ⇔Q chaque proposition est à la fois nécessaire et suffisante à l’autre proposition.1. Logique et raisonnement5

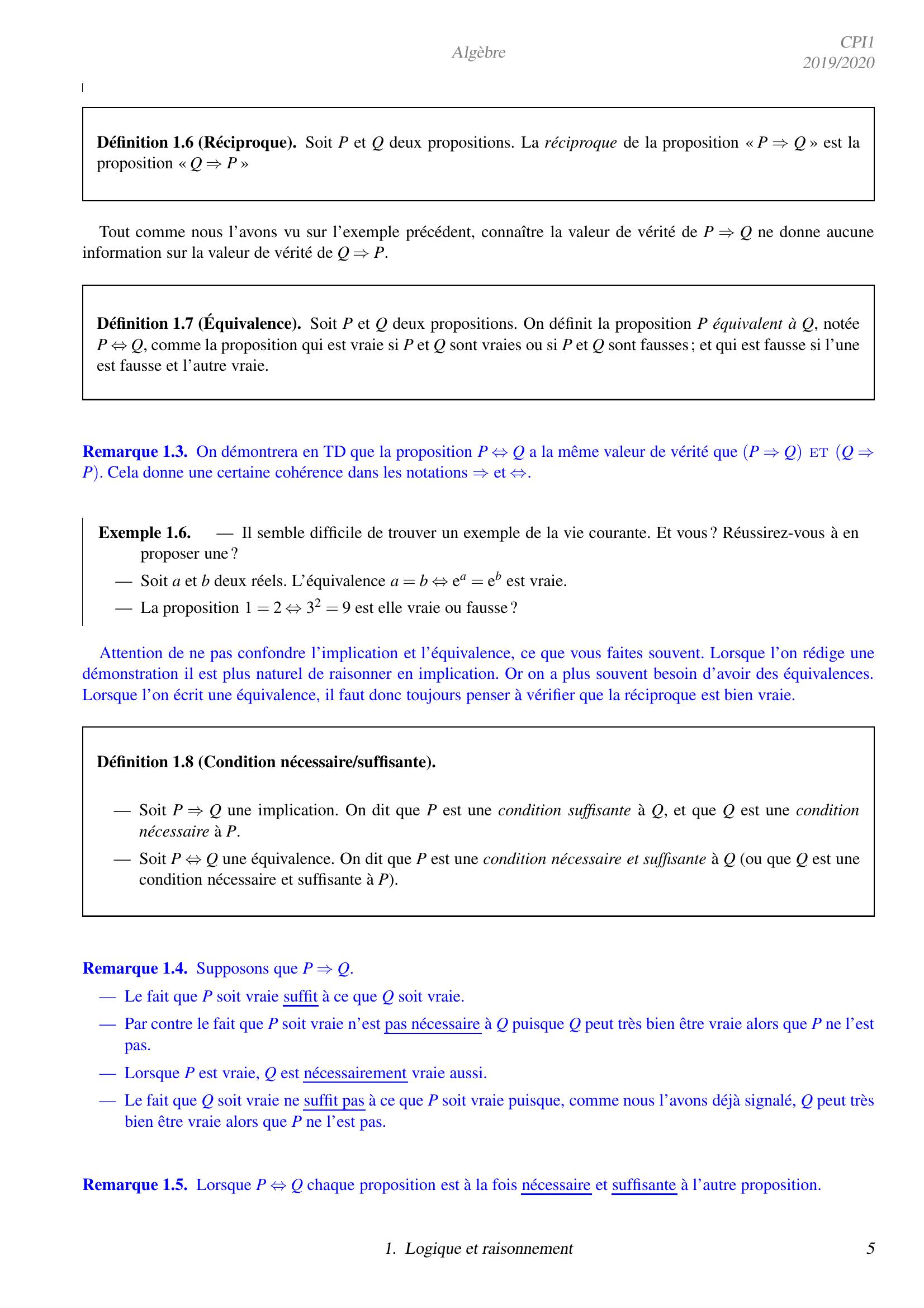

Page 12 : CPI12019/2020Algèbre1.1.3. Tables de véritéLorsque l’on fait des opérations sur des propositions, il est parfois plus aisé d’utiliser ce que l’on appelle une tablede vérité. Celle-ci résume les différentes valeurs prise par une proposition composée. Ci dessous la table de vérité desopérations définies dans la section précédente.PnonPVFFVPQP ou QP et QP ⇒QP ⇔QVVVVVVVFVFFFFVVFVFFFFFVVPropriété 1.1. Deux propositions ont la même table de vérité si et seulement si elles sont équivalentes.Démonstration. Cela découle directement de la définition d’une équivalence : Si les deux propositions prennent lesmêmes valeurs de vérité en même temps, alors l’équivalence est vraie. Réciproquement, si elles sont équivalentesalors elles prennent forcément les mêmes valeurs de vérité en même temps.□Exercice 1.1. À l’aide d’une table de vérité démontrer que les deux propositions suivantes sont vraies.1.P ou Q et R⇔P et R ou Q et R2.P et Q ou R⇔P ou R et Q ou RRemarque 1.6. On dit que la conjonction resp. la disjonction est distributive sur la disjonction resp. conjonction.1.1.4. QuantificateursParfois une propriété peut dépendre d’un élément une variable et suivant la valeur de cet élément, la propriété estvraie ou fausse. Afin de noter simplement des propositions faisant intervenir de telles propriétés, nous avons besoindes quantificateurs.Définition 1.9 Quantificateur existentiel. Soit P une propriété portant sur les éléments d’un ensemble E.La proposition « au moins un élément x de E vérifie P » se note « x E, Px ». On appelle quantificateurexistentiel le symbole « ».Exemple 1.7. Soit E l’ensemble des élèves de la classe et P la propriété « L’élève x possède des lunettes ». Laproposition x E, Px se lit « au moins un élève de la classe possède des lunettes » ou encore, « il existe unélève de la classe qui possède des lunettes ».Définition 1.10 Quantificateur universel. Soit P une propriété portant sur les éléments d’un ensemble E. Laproposition « tout élément x de E vérifie P » se note « x E, Px ». On appelle quantificateur universel lesymbole « ».61. Logique et raisonnement

Page 13 : AlgèbreCPI12019/2020Exemple 1.8. Soit E l’ensemble des élèves de la classe et P la propriété « L’élève x possède des lunettes ». Laproposition x E, Px se lit « tout élève de la classe possède des lunettes ».Définition 1.11. Soit P unepropriétéportantsurles élémentsd’unensembleE. La proposition« un et un seul élément x de E vérifie P » se note « !x E, Px ».Exemple 1.9. Soit E l’ensemble des élèves de la classe et P la propriété « L’élève x possède des lunettes ». Laproposition !x E, Px se lit « il existe un unique élève de la classe qui possède des lunettes ».Il est possible d’utiliser plusieurs quantificateurs dans une même propositions. Il faut alors faire très attention àl’ordre dans lequel ils sont utilisés. Comparez le sens des deux phrases suivantes :— Pour toute serrure, il existe une clef qui l’ouvre x, y, Px,y.— Il existe une clef qui ouvre toutes les serrures y, x, Px,y.1.1.5. NégationsNous avons vu la négation d’une simple proposition, mais qu’en est-il de la négation d’une proposition complexefaisant intervenir des opérations et des quantificateurs?Propriété 1.2. Soit P et Q deux propositions. On a alors— nonnonP ⇔P— nonP et Q ⇔nonP ou nonQPremière loi de De Morgan— nonP ou Q ⇔nonP et nonQDeuxième loi de De Morgan— nonP ⇒Q ⇔P et nonQDémonstration. La démonstration se fait très simplement avec les tables de vérités.□Propriété 1.3. Soit P une propriété portant sur les éléments d’un ensemble E. On a alors— nonx E, Px est x E, nonPx.— nonx E, Px est x E, nonPx.Remarque 1.7. Il suffit de retenir que pour écrire la négation d’une proposition contenant des quantificateurs, il fautremplacer les par des et réciproquement, et prendre la négation de la proposition.Exemple 1.10. La négation de « tous les élèves ont des lunettes » n’est pas « aucun élève n’a de lunette » mais« il existe un élève qui n’a pas de lunettes ».1. Logique et raisonnement7

Page 14 : CPI12019/2020Algèbre1.2. Différents types de raisonnements1.2.1. Raisonnement par contrapositionDéfinition 1.12 Contraposée. Soit P et Q deux propositions. La contraposée de la proposition « P ⇒Q » estla proposition « nonQ ⇒nonP »Propriété 1.4. Une implication et sa contraposée sont équivalentes. C’est-à-dire queP ⇒Q ⇔nonQ ⇒nonPDémonstration. Vous avez déjà démontré cela à l’aide des tables de vérité lors de la question 15 de l’exercice 1 dupolycopié de TD du chapitre 1 « Logique et raisonnement ». Nous allons cependant la redémontrer en utilisant lespropriétés de logique que l’on connaît déjà.P ⇒Q ⇔nonP ou Q⇔Q ou nonP⇔nonnonQ ou nonP⇔nonQ ⇒nonPRemarque 1.8.— Attention! Ne confondez pas contraposée et réciproque. Si une implication est vraie, sa contraposée est toujoursvraie, par contre sa réciproque ne l’est pas forcément.— Ainsi, lorsque l’on doit démontrer une implication du type P ⇒Q, on peut soit la démontrer directement, soitdémontrer sa contraposée : on suppose que Q est faux et on démontre que P est faux aussi.Exemple 1.11. Afin de démontrer qu’un triangle dont on connaît les longueurs des côtés n’est pas rectangle,on utilise la contraposée du théorème de Pythagore. En effet, le théorème de Pythagore « Si le triangle ABC estrectangle en A, alors BC2 = AB2 +AC2 » est équivalent à sa contraposée « Si BC2 ̸= AB2 +AC2 alors le triangleABC n’est pas rectangle en A »Remarque 1.9. Notez bien qu’un raisonnement par contraposé s’applique exclusivement à des implications, alorsqu’un raisonnement par l’absurde peut s’appliquer à différents types de propriétés.1.2.2. Raisonnement par l’absurdeOn veut montrer une proposition P. Pour cela on suppose que cette proposition est fausse, et on tente d’en déduireune absurdité. Cette absurdité peut être soit une proposition Q qui est clairement fausse, soit une proposition de typeQ = R et nonR qui est clairement fausse aussi.Intuitivement on voit bien que si l’on aboutit à une absurdité, c’est que l’hypothèse de départ P fausse était fausseet donc que P est vraie. Cela se démontre aussi en utilisant les propriétés de logique :Nous avons montré que nonP ⇒Q, or par contraposition cela revient à dire quenonQ ⇒nonnonP ou encore nonQ ⇒P. Mais puisque Q est fausse, nonQ est vraie et donc Paussi.81. Logique et raisonnement

Page 15 : AlgèbreCPI12019/2020Exemple 1.12. Un exemple fréquent consiste à vouloir démontrer une proposition P de type A ⇒B par l’ab-surde. On part donc de nonP, c’est-à-dire de A et nonB. Par divers raisonnement et calculs on aboutit àune absurdité. En général cette absurdité est la proposition nonA, qui est effectivement absurde puisque l’onest parti de A.Remarque 1.10. Attention!! L’exemple fréquent 1.12 que l’on vient de voir conduit aussi malheureusement à uneerreur tout aussi fréquente : confondre le raisonnement par contraposition et le raisonnement par l’absurde. Beaucoupde personnes pensent démontrer A ⇒B par l’absurde en écrivant des choses du type :Supposons que l’on a A et pas B. Puisque l’on n’a pas B . . ....Et donc on n’a pas A. Ce qui est absurde puisque l’on a supposé que l’on avait A.Si à aucun moment de la démonstration dans la partie en pointillée, la proposition A n’est utilisée, alors ce raison-nement est tout bêtement un raisonnement par contraposition : nonB ⇒nonA.1.2.3. Raisonnement par analyse-synthèseNous devons parfois démontrer des choses trop complexes pour être attaquées de front. Il nous faut d’abord ana-lyser le problème afin de le réduire. C’est le cas lorsque l’on cherche à montrer l’existence d’un objet un nombrepar exemple devant satisfaire certaines conditions. Une analyse du problème permet de réduire le nombre de candi-dats possibles. La synthèse consiste alors à déterminer parmi les candidats ceux qui sont effectivement solutions duproblème.Le schéma d’un raisonnement par analyse-synthèse est le suivant :Analyse : On suppose que l’objet existe et on essaie de trouver des conditions nécessaires que doit vérifier cet objet.Ce faisant, on prouve que si l’objet existe, alors il est nécessairement dans un ensemble restreint.Synthèse : On considère les objets identifiés dans la partie analyse, et on vérifie que certains ont bien les propriétésvoulues ceci assure l’existence.Remarque 1.11. Si l’analyse n’exhibe qu’un seul candidat possible, on parle alors d’unicité si existence.Exemple 1.13. Le BN géantCommençons par rendre à César ce qui appartient à César. L’exemple qui suit est tiré de cette page : http://la-bnbox.fr/c541-Le-raisonnement-par-analyse-synthese.cahierUn jour, on vous demande de prouver l’existence d’un BN au chocolat géant vivant!À première vue, cela semble assez difficile à faire. . . Et vous n’avez aucune idée de la manière de procéder.Alors procédons par Analyse-Synthèse.Analyse : Supposons qu’il existe un BN au chocolat géant vivant quelque part dans le monde.— Si un BN de ce genre existe, il est évident qu’il vivra nécessairement loin de l’eau, parce qu’un BNdans l’eau devient tout mou et se dissous. . .— Si ce type de BN existe, il se trouvera nécessairement loin des régions chaudes, sinon son chocolatfondrait et il disparaitrait.— Il sera aussi nécessairement loin des régions très froides, pour ne pas geler. Je laisse l’auteur res-ponsable de cette affirmation, personnellement je pense que rien ne prouve qu’il ne survivrait pas àdes régions très froides.Ces conditions nécessaires réduisent déjà notre champ de recherche. On sait que maintenant, le seul endroitoù on peut trouver un BN de ce type, c’est en France. Là encore je laisse l’auteur responsable de cetteconclusion un peu hâtive. . .Mais la France c’est toujours assez grand. On va donc chercher d’autres conditions nécessaires encore plusrestrictives.1. Logique et raisonnement9

Page 16 : CPI12019/2020AlgèbreUn grand BN comme ça, ça a besoin de beaucoup de chocolat pour tenir ensemble. . . Il doit donc nécessairementvivre près d’une chocolaterie, ou d’une biscuiterie.De plus, les BN sont créés à Nantes. En admettant le fait qu’un grand gaillard comme lui habite encoreprès de chez ses parents, il habite nécessairement près de Nantes.Ce qui nous amène directement à la conclusion que le BN géant habite dans la biscuiterie BN. Encore uneconclusion bien hâtive, comment de « près de Nantes » on aboutit à « dans la biscuiterie BN »? Est-ce laseule biscuiterie de la région? Passons, passons, c’est juste pour l’exemple. . .Synthèse : Nous devons vérifier notre conclusion, c’est-à-dire que nous devons prendre le premier avion ou lepremier TGV ou tout autre moyen de transport, même si ce n’est pas le premier pour Nantes et nousrendre à la biscuiterie pour vérifier que le BN géant s’y trouve.— Soit on le trouve, et on a bien prouvé qu’il existe.— Soit on ne le trouve pas, et on a prouvé qu’il n’existe pas, puisqu’il n’est pas à l’endroit où il devaitnécessairement être.Exemple 1.14. Soit xn la suite réelle définie par récurrence par x0 = 1 et xn+1 =53xn. Déterminer un majorantde xn.Le problème semble bien complexe. Une analyse s’impose!Analyse : Nous ne voyons pas du tout à quoi pourrait ressembler un majorant de xn. Supposons donc que noussoyons en présence d’un tel majorant et étudions les propriétés qu’il possède nécessairement.Tout d’abord, si un majorant existe, alors l’ensemble des majorants possède un plus petit élément c’estune propriété qui est hors programme. Notons Mmin ce plus petit des majorants.Puisque Mmin est un majorant, nous pouvons affirmer que pour tout n N, xn Mmin. En multipliant par3 l’inégalité, nous avons 3xn 3Mmin. La fonction « racine-5e » étant croissante admis, nous pouvonsprendre la racine-5e de l’inégalité pour obtenir53xn 53Mmin, c’est-à-dire :xn+1 5p3MminCeci étant vrai pour tout n N, on en conclut que pour tout n N, xn 53Mmin.Ainsi53Mmin est un majorant, il est donc plus grand que le plus petit des majorants :Mmin 5p3MminÉtant donné que u0 = 1, nous pouvons affirmer que tous les majorants sont supérieurs ou égaux à 1, enparticulier Mmin 0. Ainsi l’inégalité précédente est équivalente àM5min 3Mmin ⇔M4min 3 ⇔Mmin 43On peut donc conclure que si des majorants existent, alors43 en est un ce n’est pas forcément Mmin.Synthèse : On vérifie que43 est bien un majorant en faisant par exemple une démonstration par récurrence. Àvos stylos!Vous voyez que sans le raisonnement par analyse-synthèse vous auriez été obligé de vous reposer, soit sur uneindication de l’énoncé vous demandant de montrer que43 était un majorant, soit sur votre calculatrice pourconjecturer que 2 faisait un bon candidat.101. Logique et raisonnement

Page 17 : AlgèbreCPI12019/20201.3. Propriétés de NVous connaissez déjà très bien N, l’addition, la multiplication sur N, ainsi que les relations , , et . Nousn’allons donc pas revenir dessus.1.3.1. Définitions généralesCommençons par des définitions qui ne sont pas propres à N.Définition 1.13 Plus grand/petit élément. Soit E un ensemble possédant une relation « inférieur ou égal à »,notée « », permettant de comparer les éléments entre eux. On appelle plus grand resp. petit élément de E,un élément x de E s’il existe tel que pour tout élément y de E, y est inférieur resp. supérieur ou égal à x. Ennotation mathématiques, cela donne « y E, y x » resp. « y E, x y ».Remarque 1.12. Pourquoi préciser «s’il existe »? Tout simplement parce que l’ensemble E ne possède pas forcémentde plus grand élément. Considérez par exemple E = 0;1. Le nombre 1 est effectivement plus grand que tous leséléments de E, mais il n’appartient pas à E.Définition 1.14 Ensemble des majorants/Minorants. Soit E et F deux ensembles possédant une relation« inférieur ou égal à », notée « », permettant de comparer les éléments entre eux et tels que E F. On ap-pelle ensemble des majorants resp. minorants de E dans F, tous les éléments de F qui sont supérieurs resp.inférieurs à tous les éléments de E. Un tel élément est simplement appelé majorant resp. minorant de E. Ennotation mathématiques, dire que x est un majorant resp. minorant de E, revient à dire « y E, y x » resp.« y E, x y ».Si l’ensemble des majorants resp. minorants est non vide, on dit que E est une partie majorée resp. minoréede F.Remarque 1.13. Comme le laisse entrevoir la définition, l’ensemble des majorants ou minorants peut être vide.Prenez par exemple E = 0;+. Il n’existe aucun élément réel qui soit supérieur à tous les éléments de E.Remarquez qu’un majorant ou un minorant n’appartient pas forcément à l’ensemble E.Exemple 1.15. Si on reprend l’ensemble évoqué plus haut, E = 0;1 :— E ne possède pas de plus grand élément.— 0 est le plus petit élément de E.— ;0 est l’ensemble des minorants de E remarquez que 0 en fait parti.— 1;+ est l’ensemble des majorants de E.1.3.2. Parties de NNous nous intéressons maintenant plus particulièrement à N et à ses sous-parties.Axiome 1.1. Toute partie non vide de N possède un unique plus petit élément.1. Logique et raisonnement11

Page 18 : CPI12019/2020AlgèbreDémonstration. Un axiome, par définition, n’a pas besoin de démonstration. Cependant, l’unicité du plus petit élé-ment ne fait en réalité pas partie de l’axiome. Nous allons donc le démontrer.Pour démontrer l’unicité d’un objet, la méthode classique consiste à supposer qu’il en existe deux et à démontrerqu’ils sont nécessairement égaux.Supposons donc que l’on a A une partie non vide de N. Puisque A est non vide, elle possède au moins un élémenta. Si A ne possède qu’un seul élément, la démonstration s’arrête là! On suppose donc de plus que A possède au moinsdeux éléments et qu’ils sont tout deux un « plus petit élément de A ». Notons les a et b. Puisque a est un plus petitélément de A et que b A, nous avons a b. De même nous avons nécessairement b a. Cela revient à dire quea = b et que le plus petit élément est forcément unique.□Propriété 1.5. Toute partie majorée non vide de N possède un unique plus grand élément.Démonstration. La démonstration de l’unicité du plus grand élément est la même que pour le plus petit élément.Focalisons nous donc sur l’existence.Soit A une partie majorée non vide de N. Puisque A est majorée, elle possède des majorants!, notons B l’ensemblede ses majorants, qui est non vide. D’après l’axiome 1.1, B admet un plus petit élément que l’on note m. Montronsque m appartient à A. Nous allons faire un raisonnement par l’absurde.Supposons que m n’appartient pas à A et montrons que l’on aboutit à une absurdité contradiction. Comme m est unmajorant de A, on ax A, x mOr x appartient à A et m n’appartient pas à A, ils sont donc distincts et par conséquentx A, x mCela impose que m 1 sinon on aurait : x A, x 0, ce qui est impossible puisque nous sommes dans N et que Aest non vide et que m1 appartient à N. Nous avons doncx A, x m1C’est la définition d’un majorant, donc m1 est un majorant de A et appartient à B. Or m était censé être le plus petitélément de B. Nous arrivons ainsi à une absurdité et pouvons conclure que notre supposition d’origine m /A étaitfausse. D’où m A, m majore A, c’est bien le plus grand élément de A.Nous avons donc montré l’existence d’un plus grand élément de A.□1.3.3. Raisonnement par récurrenceVous avez déjà vu le raisonnement par récurrence au lycée. Nous allons le démontrer.Théorème 1.1 Principe de récurrence. Soit A une partie de N telle que,1. A contient 0.2. Si A contient un entier n, alors A contient n+1.Alors A = N.Démonstration. Nous devons montrer que A = N. La méthode classique consiste à faire une double inclusion. Cen’est pas ce que nous allons faire ici. . . Nous allons montrer que N\A N privé de A est l’ensemble vide par unraisonnement par l’absurde et en conclure que A = N.121. Logique et raisonnement

Page 19 : AlgèbreCPI12019/2020Soit une partie A de N vérifiant les conditions de la propriété. Supposons que N\A est non vide. En vertu del’axiome 1.1, il possède un plus petit élément que nous noterons m. Par définition, m n’appartient pas à A. Or d’aprèsla condition 1, 0 appartient à A, donc nécessairement, m est différent de 0 et m 1 N. Un élément de N appartientsoit à A soit à N\A, de plus m 1 ne peut pas appartenir à N\A, sinon m ne serait pas le plus petit élément. D’oùm 1 appartient à A. D’après la condition 2 nous avons nécessairement m 1+ 1 = m qui appartient à A. Or m nepeut appartenir à la fois à A et à N\A. D’où l’absurdité et N\A est l’ensemble vide. Nous en concluons que A = N. □Remarque 1.14. L’énoncé du théorème 1.1 peut-être légèrement modifié pour « démarrer » à partir d’un entier n0 :Soit A une partie de N telle que1. A contient n0.2. Si A contient un entier n n0, alors A contient n+1.Alors A = Jn0 ;+J.Propriété 1.6 Récurrence simple. Soit P une propriété portant sur les entiers naturels.Soit n0 un entier naturel.On suppose que Pn0 est vraie.On suppose également que pour tout entier n n0, si Pn est vraie, alors Pn+ 1 est vraie cela revient à direque l’implication Pn ⇒Pn+1 est vraie.Alors pour tout entier n n0, la proposition Pn est vraie.Démonstration. Soit P un propriété vérifiant les conditions de l’énoncé. Soit A = n N, Pn A est l’ensembledes entiers naturels tels que P est vraie. Alors A vérifie les conditions du théorème 1.1 ou plutôt de sa versionmodifiée de la remarque 1.14. Donc A = Jn0 ;+J et tout entier n n0 vérifie P.□Voici comment doit se faire un raisonnement par récurrence et comment il doit être rédigé.1. On énonce clairement la propriété P étudiée.2. On vérifie que la propriété P est vraie pour n0 Initialisation.3. On se donne un entier n n0 quelconque et on suppose que Pn est vraie Hypothèse de récurrence.On démontre alors que Pn+1 est vraie Hérédité.4. On conclut en annonçant que, par récurrence, la propriété est vraie pour tout entier n n0.Il faut voir le principe de récurrence comme une échelle que l’on essaye de monter : Si l’on est capable de poserle pied sur le premier barreau et que l’on est capable de passer d’un barreau au suivant, alors on est capable demonter l’échelle en entier. Si l’une des deux conditions manque, alors nous ne pouvons pas monter l’échelle. D’oùl’importance de vérifier l’initialisation ET l’hérédité. Une erreur classique est d’oublier l’initialisation. L’exemple 1.16est un exemple de cette erreur classique.Exemple 1.16. FAUX! Démontrer par récurrence que pour tout n N, on a l’égalité1+2+3+···+n = n2 +n+121. Soit Pn la propriété définie sur Npar « 1+2+3+···+n = n2 +n+12».2. L’élève oublie l’initialisation.3. Soit un entier n Ntel Pn est vraie. Démontrons alors que Pn+1 est vraie aussi. Nous devons donc1. Logique et raisonnement13

Page 20 : CPI12019/2020Algèbremontrer que1+2+3+···+n+n+1 = n+12 +n+1+12La fraction est égale à n2 +3n+32. Nous avons supposé que Pn est vrai, donc on peut écrire :1+2+···+n+n+1 = 1+2+···+n+n+1= n2 +n+12+n+1= n2 +n+1+2n+22= n2 +3n+32= n+12 +n+1+12Donc l’implication Pn ⇒Pn+1 est vraie.4. Nous avons donc montré par récurrence que pour tout entier n N, 1+2+3+···+n = n2 +n+12.Vous l’aurez compris, il y a une erreur. Un calcul simple permet de montrer que P1 est fausse puisqu’ellestipule que 1 = 32. Le premier barreau étant cassé, nous ne pouvons pas monter à l’échelle.Exemple 1.17. Démontrer par récurrence que pour tout n N, on a l’égalité1+2+3+···+n = nn+121. Soit Pn la propriété définie sur Npar 1+2+3+···+n = nn+12.2. Nous avons 1 = 11+12. Donc P1 est vraie.3. Soit un entier n Ntel Pn est vraie. Démontrons alors que Pn+1 est vraie aussi. Nous devons doncmontrer que1+2+3+···+n+n+1 = n+1n+22Nous avons supposé que Pn est vrai, donc on peut écrire :1+2+···+n+n+1 = 1+2+···+n+n+1= nn+12+n+1= nn+1+2n+12= n+1n+22Donc l’implication Pn ⇒Pn+1 est vraie.4. Nous avons donc montré par récurrence que pour tout entier n N, 1+2+3+···+n = nn+12.141. Logique et raisonnement

Page 21 : AlgèbreCPI12019/2020Il arrive parfois que supposer simplement Pn vraie ne suffise par à démontrer que Pn+ 1 soit vraie aussi etqu’il faut supposer en plus que Pk est vraie pour tout k n. C’est le principe de la récurrence forte.Propriété 1.7 récurrence avec prédécesseurs. Soit P une propriété portant sur les entiers naturels.Soit n0 et m deux entiers naturels.On suppose que Pn0, Pn0 +1, . . ., Pn0 +m sont vraies.On suppose également que pour tout entier n n0, l’implicationPn et Pn+1... et Pn+m ⇒Pn+m+1est vraie.Alors pour tout entier n n0, la proposition Pn est vraie.Démonstration. Admis.□Remarque 1.15. Attention à l’étape d’initialisation : il faut vérifier que la propriété est vraie pour les m+1 premièresvaleurs!Remarque 1.16. Le plus souvent Pn vraie et Pn+1 vraie suffit à montrer que Pn+2 est vraie. Dans ce casm = 1 on parle de récurrence double.Exemple 1.18. Soit un une suite réelle définie de la façon suivante : u0 = 1; u1 = 3 et pour tout entier n,un+2 = 3un+1 2un. Démontrer que n N, un = 2n+1 1.Nous allons faire la démonstration à l’aide d’une récurrence double.1. Soit Pn la propriété définie sur N par « un = 2n+1 1 ».2. Nous avons u0 = 1 = 20+1 1 et u1 = 3 = 21+1 1. Donc P0 et P1 sont vraies.3. Soit un entier n N tel que Pn et Pn+1 sont vraies. Démontrons alors que Pn+2 est vraie aussi.Nous devons donc montrer que un+2 = 2n+3 1. Nous avons supposé que Pn et Pn+ 1 sont vraies,c’est-à-dire un = 2n+1 1 et un+1 = 2n+2 1. Il s’en suit que :un+2 = 3un+1 2un= 32n+2 122n+1 1= 3×2n+2 32n+2 +2= 2×2n+2 1= 2n+3 1Donc Pn+2 est vraie et par conséquent l’implication Pn et Pn+1 ⇒Pn+2 aussi.4. Nous avons donc montré par récurrence double que pour tout entier n N, un = 2n+1 1.1. Logique et raisonnement15

Page 22 :

Page 23 : 2. EnsemblesIl faut n’appeler Science que l’ensembledes recettes qui réussissent toujours. Toutle reste est littérature.Paul Valéry/Moralités.2.1. DéfinitionsLa définition rigoureuse d’un ensemble est hors-programme. Pourtant vous en avez déjà une connaissance intui-tive et les manipulez déjà depuis longtemps. Nous allons pourtant en donner une définition, certes incorrecte, maislargement suffisante à notre niveau et bien meilleur qu’une simple « intuition ».Définition 2.1 Ensemble.— Soit un univers U contenant des objets, et des propositions vraies ou faussesà propos des éléments de U .Nous appelons ensemble la collection des éléments de U qui rendent vraie une proposition P.Si E est un ensemble et P la proposition permettant de construire E, on noteE = x U / PxLes objets x qui vérifient P sont appelés éléments de E. On note alors x E.Si un objet x n’est pas élément de E il ne vérifie donc pas P, on note x /E.— L’ensemble qui ne contient aucun élément est appelé ensemble vide et est noté /0.— Un ensemble qui ne contient qu’un seul élément est appelé singleton.Remarque 2.1. Si vous voulez comprendre pourquoi cette définition est inexacte, je vous invite à faire des recherchessur le paradoxe de Bertrand Russel et la collection y = x / x /x dont on peut montrer que si elle existe, alors ellen’existe pas. . .Remarque 2.2. Comme écrit en préambule, vous n’avez pas attendu cette définition tordue pour manipuler depuislongtemps des ensembles, en particulier les ensembles de nombre U est l’univers contenant tous les nombres réels :— N = x U / x 0 et l’écriture de x n’admet pas de décimales ensemble des entiers naturels.— Z = x U / l’écriture de x n’admet pas de décimales ensemble des entiers relatifs.— D = x U / la partie décimale de x est finie ensemble des décimaux.— Q = x U / x peut s’écrire comme le quotient de deux éléments de Z ensemble des rationnels.— R = x U / x est dans U ensembles des réels.— 2;π = x U / 2 x π intervalle.— x U / x Z et n Z / x = 2n = 2n / n Z ensemble des nombres pairs.17

Page 24 : CPI12019/2020AlgèbreRemarque 2.3. La définition 2.1 précédente est ce que l’on appelle une définition en compréhension. Les ensemblesayant un nombre fini d’éléments et pas trop grand peuvent être définis en extension, c’est-à-dire en énumérant tousleurs éléments d’où la nécessité d’en avoir un nombre fini pas trop important!. Par exemple les nombres premierspositifs inférieurs à 20 : 2,3,5,7,11,13,17,19. Dans ce cas, l’ordre dans lequel sont énuméré les éléments n’a pasd’importance.Définition 2.2 Égalité. Soit E et F deux ensembles. On dit que E et F sont égaux s’ils ont exactement lesmêmes éléments, c’est-à-dire si :x, x E ⇔x FOn note E = F.Définition 2.3 Inclusion. Soit E et F deux ensembles. On dit que E est inclus dans F ou que F contient E,ou encore que E est un sous-ensemble de F, ou encore que E est une partie de F si tous les éléments de Eappartiennent à F, c’est-à-dire si :x, x E ⇒x FOn note E F.Remarque 2.4. Il est clair que E = F ⇔E F et F ERemarque 2.5. Attention! Vous confondez souvent l’inclusion et l’appartenance, ce qui n’a strictement rien à voir :— Un élément appartient à un ensemble x E— Un ensemble est inclus dans un ensemble E FPar exemple une bille appartient à un sac de billes, mais elle n’est pas incluse dans ce sac.Un sac de billes est inclus dans un coffre à jouets, mais il n’appartient pas à ce coffre une bille est un jouet à partentière, mais un sac de billes n’est pas un jouet.Remarque 2.6. Méthode— Afin de montrer une inclusion E F, on doit montrer que tout élément x de E est dans F. La rédaction est doncforcément la suivante :Soit x E. Montrons que x F....D’où x F et E F.— Afin de montrer une égalité, il y deux manière de faire :Par équivalence : Cette méthode n’est pas recommandée car vous écrivez souvent des équivalences qui sonten réalité des implications. La rédaction est alors une succession d’équivalences :Soit x U .x E ⇔...⇔......⇔x F182. Ensembles

Page 25 : AlgèbreCPI12019/2020Par double inclusion : Comme son nom l’indique, on utilise la remarque 2.4 en montrant d’abord que E Fpuis que F E :E F : Soit x E. . . . Donc x F.F E : Soit x F. . . . Donc x E.Définition 2.4 Ensemble des parties. Soit E un ensemble. L’ensemble des parties de E est noté PE.Ainsi, pour tout ensemble F : F PE ⇔F ERemarque 2.7. Attention! Ouch! Nous avons utilisé le symbole « » avec un ensemble! Oui, car cette fois cetensemble est considéré comme un objet élément de l’ensemble des parties.Propriété 2.1. Pour tout ensemble, nous avons toujours E PE et /0 PE.Démonstration.—x, x E ⇒x EDonc par définition, E E et E PE.— De même :x,x /0zFaux. . .⇒x Ez. . .donc vrai. . .z. . . donc vrai!Donc par définition, /0 E et /0 PE.Exemple 2.1.P 0,1,2 =/0z0 élément,0,1,2z1 élément,0,1,0,2,1,2z2 éléments,0,1,2 z 3 éléments2.2. OpérationsDéfinition 2.5 Intersection et Union. Soit E et F deux ensembles.— On appelle intersection de E et F l’ensemble noté E F des éléments qui sont à la fois dans E et dans F.C’est-à-direx E F ⇔x E et x F— On appelle union de E et F l’ensemble noté E F des éléments qui sont dans E ou dans F. C’est-à-direx E F ⇔x E ou x F2. Ensembles19

Page 26 : CPI12019/2020AlgèbreRemarque 2.8. Vous aurez noté l’analogie à la fois dans le sens et dans la notation entre— l’intersection notée et le et logique noté aussi .— l’union notée et le ou logique noté aussi .Cette définition peut être généralisée à plus de deux ensembles.Définition 2.6 Intersection et Union d’une famille d’ensembles. Soit I un ensemble et EiiI une familled’ensembles.— On appelle intersection des Ei, i décrivant I, notée TiIEi, l’ensemble des éléments qui sont dans tous les Ei.C’est-à-dire x \iIEi!⇔i I, x Ei— On appelle union des Ei, i décrivant I, notée SiIEi, l’ensemble des éléments qui sont dans au moins l’un desEi. C’est-à-dire x iIEi!⇔i I, x EiRemarque 2.9.— En général, l’ensemble I de la définition précédente est un ensemble d’entiers naturels, mais pas forcément. Iln’est même pas obligé d’être discret!— On remarquera cette fois que l’intersection fait appel à la notion de « Pour tout » et que l’union fait appel àla notion de « Il existe » .Définition 2.7 Ensembles disjoints. Deux ensembles E et F sont dit disjoints si leur intersection est videE F = /0. Dans ce cas, on dit que l’union E F est une union disjointe et on la note parfois E F ou en-core E ˙F.Définition 2.8 Complémentaire et Différence. Soit E un ensemble, et A et B deux sous-ensembles de E.— On appelle complémentaire de A dans E l’ensemble des éléments de E qui ne sont pas dans A. Cet ensembleest noté E\A ou EA ou A ou A s’il n’y a pas d’ambigüité sur l’ensemble E pour les deux dernièresnotations. C’est-à-direEA = x E / x /A— On appelle différence de A dans B, notée B\A, l’ensemble des éléments appartenant à B, mais pas à A.C’est-à-direB\A = BA202. Ensembles

Page 27 : AlgèbreCPI12019/2020Définition 2.9 Différence symétrique. Soit E et F deux ensembles. On appelle différence symétrique de E etF, que l’on note EF, l’ensemble des éléments qui sont dans un et un seul des deux ensembles E et F. C’est-à-direEF = E F\E FDéfinition 2.10 n-uplet et Produit cartésien. Soit n N, n 2 et E1,E2,...,En, n ensembles.— Soit 1 k n et xk Ek. On appelle n-uplet de composantes x1, x2,. . .,xn dans cet ordre l’objet notéx1,x2,...,xn.— On appelle produit cartésien de E1, E2, . . ., En, que l’on note E1 × E2 × ··· × En, l’ensemble des n-upletsx1,x2,...,xn.Si E1 = E2 = ··· = En = E, on note simplement En le produit cartésien.Exemple 2.2. Si E et F sont deux ensembles, alors E ×F = x;y / x E et y FRemarque 2.10. Attention! Ne pas confondre un n-uplet dans lequel l’ordre des éléments compte et un ensemblex1,x2,...,xn dans lequel l’ordre des éléments importe peu :1;2 ̸= 2;11,2 = 2,1Définition 2.11 Partition. Soit E un ensemble, I un ensemble d’indices et EiiI une famille de parties de E.On dit que EiiI est une partition de E si :— Aucun des ensembles Ei n’est vide : i I, Ei ̸= /0.— Les Ei sont disjoints deux à deux : i; j I2, i ̸= j ⇒Ei E j = /0.— La réunion des ensembles Ei est égale à E tout entier : SiIEi = E.Dans ces conditions, tout élément x de E appartient à un sous-ensemble Ei unique.2.3. PropriétésPropriété 2.2 Règles de calculs sur l’intersection et l’union. Soit E un ensemble et A, B et C trois sous-ensembles de E.— AB = BA L’intersection est commutative— ABC = ABC L’intersection est asso-ciative— AE = E A = A E est l’élément neutre de l’in-tersection— AB = BA L’union est commutative— ABC = ABC L’union est associative— A /0 = /0 A = A /0 est l’élément neutre del’unionDémonstration. Toutes ces propriétés découlent des définitions et des mêmes propriétés sur les opérateurs logiqueset et ou . Toutefois, nous allons détailler le troisième point de l’intersection à vous d’adapter pour l’union :2. Ensembles21

Page 28 : CPI12019/2020AlgèbreAE A : Évident par définition de l’intersection.A AE : Soit x A. Puisque A E, nous avons x E. Par conséquent, il appartient à A et à E, donc à AE.D’où l’inclusion.Nous avons bien démontré l’égalité par double inclusion.□Propriété 2.3 Distributivité de l’intersection sur l’union et réciproquement. Soit E, F, G trois ensembles.Alors— E F G = E G F G distributivité àdroite de l’union sur l’intersection.— E F G = E F E G distributivité àgauche de l’union sur l’intersection.— E F G = E G F G distributivité àdroite de l’intersection sur l’union.— E F G = E F E G distributivité àgauche de l’intersection sur l’union.Démonstration. Cela provient tout simplement des propriétés démontrées dans l’exercice 1.1 du chapitre 1« Logique et raisonnement ».□Remarque 2.11. Afin de retenir plus facilement ces quatre formules, il suffit de remplacer « » par « + » et « » par« × », et inversement. En effet, vous avez depuis longtemps sans l’avoir nommé que la multiplication est distributiveà droite et à gauche sur l’addition.Remarque 2.12. Généralisation Ces propriétés peuvent se généraliser à une famille infinie d’ensembles :E \iIFi!=\iIE FiE iIFi!=iIE FiDans le cas d’une famille finie, il suffit de faire une récurrence. Montrons la seconde égalité pour une famille quel-conque.Démonstration.: Soit x E iIFi!. Il appartient donc d’une part à E, d’autre part à l’unioniIFi. Donc il existe j I, tel quex Fj. Donc, puisque x appartient aussi à E, il appartient à E Fj. Et puisqu’il existe un j I tel que x E Fj,il appartient à l’union :iIE Fi.: Soit x iIE Fi. Donc il existe un j I, tel que x E Fj. Il appartient donc d’une part à E et d’autre partà Fj. Ainsi, il appartient aussi à l’unioniIFi. Mais comme il appartient aussi à E, il appartient à l’intersection :E iIFi!222. Ensembles

Page 29 : AlgèbreCPI12019/2020Propriété 2.4 Passage au complémentaire. Soit E un ensemble et, A et B deux sous-ensembles de E.— A = A— AB = AB— AB = ABDémonstration. Cela découle encore des propriétés de logique, notamment des lois de De Morgan vues dans lapropriété 1.2 du chapitre 1 « Logique et raisonnement ».□Remarque 2.13. Généralisation Là encore, cela se généralise à une famille infinie d’ensembles :iIAi =\iIAi\iIAi =iIAiLa démonstration est simple la deuxième vous est laissée en exercice :Démonstration.x iIAi ⇔x /iIAi ⇔i I, x /Ai ⇔i I, x Ai ⇔x \iIAi□2. Ensembles23

Page 30 :

Page 31 : 3. Relations binairesL’autorité, c’est moins la qualité d’unhomme qu’une relation entre deux êtres.Maurice Barrès.3.1. VocabulaireDéfinition 3.1 Relation. On appelle relation, notée R, la donnée de :— Un ensemble de départ E non vide.— Un ensemble d’arrivée F non vide.— Un graphe G E ×F, c’est-à-dire une partie de E ×F.Soit x E et y F. Si x;y G, on dit que x est en relation avec y pour R et on notera xRy. Dans ce cas, y estappelé image de x par R et x un antécédent de y par R.Définition 3.2 Relation binaire. Soit E un ensemble non vide. On appelle relation binaire sur E une relationdont E est à la fois l’ensemble de départ et l’ensemble d’arrivée.Remarque 3.1. Une relation binaire sur E est donc tout simplement un sous-ensemble de E2.Définition 3.3. Soit R une relation binaire sur un ensemble E. On dit que R estRéflexive lorsque :x E, xRxSymétrique lorsque :x;y E2, xRy ⇒yRxAntisymétrique lorsque :x;y E2, xRy et yRx ⇒x = yTransitive lorsque :x;y;z E3, xRy et yRz ⇒xRz25

Page 32 : CPI12019/2020Algèbre3.2. Relations d’équivalenceDéfinition 3.4 Relation d’équivalence. On dit qu’une relation binaire R sur un ensemble E est une relationd’équivalence lorsqu’elle est réflexive, symétrique, transitive « RST ».Définition 3.5 Classe d’équivalence. Soit R une relation d’équivalence sur un ensemble E et x E. On appelleclasse d’équivalence de x l’ensemble des éléments de E en relation avec x :cℓx = y E / xRyPropriété 3.1. Soit E un ensemble et R une relation d’équivalence sur E. Alors1. x,y E, cℓx = cℓy ⇔xRy2. Les classes d’équivalence forment une partition de E.Démonstration.1. Soit x;y E2.⇒y cℓy = cℓx, donc xRy.⇐Soit z cℓx. Nous avons donc xRz. Or par hypothèse, xRy. Donc par symétrie et transitivité, nousavons yRz, c’est-à-dire z cℓy.Même démonstration en intervertissant x et y.2.a Elles sont clairement non vides, puisque pour tout x E, x cℓx réflexivité.b Soit z cℓycℓx, par transitivité et symétrie nous avons :t E, t cℓx ⇔xRt ⇔tRz ⇔tRy ⇔t cℓyD’où cℓx = cℓy. Les classes sont donc deux à deux disjointes.cPar définition d’une classe d’équivalence, il est évident quexEcℓx EPuisque pour tout x E, nous avons x cℓx c’est-à-dire x cℓx, nous en déduisons que :E =xEx xEcℓxPar double inclusion, nous avons bien E =xEcℓx.Exemple 3.1. Vous connaissez déjà des relations d’équivalence :— L’égalité « = » entre deux nombres complexes, deux ensembles, deux fonctions, deux . . .— La relation d’équivalence oui!, c’est pour cela que cela s’appelle ainsi. Comme quoi les maths, c’est bienfait, non? « ⇔».— La relation de congruence modulo un réel rencontrée depuis la seconde en trigonométrie : Soit θ Retx,y R. On dit que x est congru à y modulo θ, si et seulement si :x = ymod θ ⇔k Z, x = y+kθ263. Relations binaires

Page 33 : AlgèbreCPI12019/2020Remarque 3.2. Ceux qui ont fait de l’arithmétique en spécialité maths ont aussi vu la congruence sur Z.C’est exactement la même, mais avec des entiers.3.3. Relations d’ordreDéfinition 3.6 Relation d’ordre. Soit E un ensemble et R une relation binaire sur E. On dit que R est unerelation d’ordre lorsqu’elle est réflexive, antisymétrique, transitive.On les note généralement ou . On dit alors que E ;R est un ensemble ordonné.Exemple 3.2. Là encore vous connaissez déjà des relations d’ordre :— sur R, mais aussi sur l’ensemble des fonctions.— sur PE.— Mais aussi « l’ordre alphabétique » sur l’ensemble des mots d’où son nom!De plus si est une relation d’ordre, on peut toujours définir une relation d’ordre « inverse », que l’on notera ,parx;y E2, x y ⇔y xDéfinition 3.7 Relation d’ordre stricte. Soit E un ensemble et R une relation binaire sur E. On dit que R estune relation d’ordre stricte lorsqu’elle est transitive et pour tout x;y E2, xRy ⇒x ̸= yDéfinition 3.8 Relation stricte associée à une relation d’ordre. Soit E un ensemble et une relation d’ordresur E. La relation sur E définie pour tous x,y E par :x y ⇔x y et x ̸= yest transitive et est appelée la relation stricte associée à .Démonstration. Montrons que la relation ainsi définie est bien transitive et donc une relation d’ordre stricte,puisque la condition xRy ⇒x ̸= y est incluse dans la définition. Soit donc x,y,z E tels que x y et y z.Montrons que x z. Nous avons donc x y et y z, donc par transitivité de , x z. Il ne reste plus qu’à démontrerque x ̸= z. Supposons que x = z, alors x y et y z = x, donc par antisymétrie de , nous avons y = x. Or x ̸= ypuisque x y. Donc x ̸= z et x z.La relation ainsi définie est donc bien une relation d’ordre stricte.□Remarque 3.3. Comme l’indique 2 sur son excellent site, la relation est aussi antisymétrique. Cependant la raisonde son antisymétrie est vraiment tordue, au point que la démonstration de 2 est fausse ce qui ne dénature en rienl’excellente qualité de ses cours! Voyons cela en détail :Nous devons montrer que x;y E2, x y et y x ⇒x = y. Soit donc x;y E2.Si x = y : Dans ce cas, la relation x y est fausse, donc x y et y x est fausse aussi et l’implication est vraie.Oui! Rappelez-vous, si P est fausse, alors P ⇒Q est vraie.Si x ̸= y : Supposons que l’on ait x y et y x, alors dans ce cas, on a x y et y x, donc pas antisymétrie de ,x = y. Ceci est absurde, donc l’hypothèse de départ ne peut être vraie. Cela veut dire que soit x y, soit y x3. Relations binaires27

Page 34 : CPI12019/2020Algèbreou les deux à la fois, voir la définition d’un ordre total 3.9.Là encore, puisque la proposition x y et y x est forcément fausse, l’implication est vraie!Vous constatez que l’implication n’est vraie uniquement parce que la propriété x y et y x est toujours fausse.Vous constatez du même coup l’importance d’avoir mis une implication dans la définition de l’antisymétrie. Si on seramène à la première relation antisymétrique rencontrée dans votre scolarité, c’est-à-dire « » sur les réels, on seraittenté de se dire que si x = y, alors oui, x y et y x, et donc on peut mettre une équivalence à la place de l’implication.C’est là que se ramener à des exemples simples que l’on maitrise pour comprendre une définition peut vous fairetomber dans un piège. En effet, si on met une équivalence dans la définition de l’antisymétrie, la relation d’ordrestricte associée à une relation d’ordre n’est plus antisymétrique puisque la proposition x = y ⇒x y et y x estfausse.Une remarque sur cette remarque : d’après la définition d’un ordre stricte, rien n’oblige la relation stricte associée àêtre antisymétrique. Donc finalement rien n’empêche de mettre une équivalence dans la définition de l’antisymétrie.C’est vrai. Cela vous montre qu’en mathématiques, tout est question de choix dans les définitions mais surtout decohérence des les propriétés énoncées par la suite!Définition 3.9 Ordre total. Soit E un ensemble et une relation d’ordre sur E. On dit que est une relationd’ordre total et que E ; est un ensemble totalement ordonné lorsquex;y E2, x y ou y xDans le cas contraire, l’ordre est dit partiel et E ; est dit ensemble partiellement ordonné.Remarque 3.4. En des termes plus simples, l’ordre est total si tous les éléments peuvent se comparer entre eux. Larelation « » est un ordre total. Cependant la relation « » est un ordre partiel puisque tous les ensembles ne sontpas forcément inclus les uns dans les autres.Définition 3.10 Majorant/Minorant. Soit E ; un ensemble ordonné, A E et m E. On dit que :— m est un minorant de A si x A, m x. On dit alors que A est minoré.— m est un majorant de A si x A, x m. On dit alors que A est majoré.— A est borné si il est minoré et majoré.Définition 3.11 Plus petit/grand élément, minimum/maximum. Soit E ; un ensemble ordonné, A E etm E. On dit que :— m est un plus petit élément ou un minimum de A si m est un minorant de A et m A.— m est un plus grand élément ou un maximum de A si m est un majorant de A et m A.Remarque 3.5. D’après la définition, il n’est pas clair qu’un minimum ou maximum existe toujours, ni qu’il soitunique. Par exemple, dans l’ensemble E = R;, A = 0;1 est bien minoré, majoré, donc borné, admet un maximum1, mais pas de minimum 0 ̸= 0;1. Quant à l’unicité. . .283. Relations binaires

Page 35 : AlgèbreCPI12019/2020Propriété 3.2 Unicité du minimum/maximum. Soit E ; un ensemble ordonné et A E.— Si A admet un minimum, alors il est unique et on le note minA.— Si A admet un maximum, alors il est unique et on le note maxA.Démonstration. Supposons que A possède deux minima m1 et m2. Par définition d’un minimum, nous avons m1 Aet m2 A. De plus, par définition d’un minorant, nous avons aussi m1 m2 et m2 m1, d’où m1 = m2 et l’unicité s’ilexiste du minimum.□Définition 3.12 Borne inférieure/supérieure. Soit E ; un ensemble ordonné et A E.— Si l’ensemble B des minorants de A est non vide et si B a un plus grand élément, m, alors celui-ci est appeléborne inférieure de A. On le note m = infA.— Si l’ensemble C des majorants de A est non vide et si C a un plus petit élément, M, alors celui-ci est appeléborne supérieure de A. On le note M = supA.Remarque 3.6. Vous remarquez qu’une borne supérieure ou inférieure n’appartient pas forcément à l’ensemble A.Exemple 3.3.— Dans R;, A = 0;1. Comme nous l’avons vu, A ne possède pas de minimum, son maxi-mum est 1. Sa borne supérieure est supA = 1 et sa borne inférieure est infA = 0.— Soit E un ensemble et, A et B deux parties de E. On munit PE de la relation d’ordre partiel « ».L’ensemble A,B admet un plus petit élément et du coup un plus grand si et seulement si A B ouB A. Dans ce cas, la borne inférieure est A ou B et la borne supérieure est B ou A.Dans tous les cas, la borne inférieure est A B et la borne supérieure est A B. En effet, A B A etA B B, donc A B est un minorant de A,B. De plus, si C est un minorant de A,B, alors C A etC B, donc C AB. En conclusion, AB est bien le pus grand des minorants, soit la borne inférieure.De même pour AB.Propriété 3.3. Soit E ; un ensemble ordonné et A E.— Si A admet un minimum, alors A admet une borne inférieure et minA = infA.— Si A admet un maximum, alors A admet une borne supérieure et maxA = supA.Démonstration. Supposons que A admette un minimum m et montrons que m est le plus grand des minorants deA. Tout d’abord, par définition d’un minimum, m est bien un minorant de A. Ensuite, soit x un minorant de A, pardéfinition et puisque m A c’est un minimum, nous avons x m. Ainsi, m est bel et bien le plus grand des minorants,soit la borne inférieure de A.□3. Relations binaires29

Page 36 :

Page 37 : 4. Applications4.1. FondamentauxDéfinition 4.1 Application. Soit R une relation d’ensemble de départ E, d’arrivée F et de graphe G. La relationR est appelée application si et seulement si tout antécédent x de E possède une unique image y de F.Dans ce cas, au lieu d’écrire xRy, on écrira y = Rx et y est l’image de x par R.L’ensemble des applications de E vers F est noté FE ,F ou encore FE.Remarque 4.1.— Les applications ressemblent énormément aux fonctions. La seule différence qui n’est pas au programme, doncvous avez le droit de les confondre est que pour une application, tout élément de E possède une et une seuleimage l’application est définie partout, alors que pour une fonction, tout élément de E possède au plus uneimage donc soit pas d’image, soit une seule, elle n’est pas forcément définie partout.— Pour désigner une application donc une fonction, on utilise en générale une lettre minuscule et on écrit :f : E→Fx7→y = fx— La nature des ensembles E et F n’est pas précisée. Ce ne sont donc pas forcément des ensembles de réels. Onpeut avoir des applications sur n’importe quels objets mathématiques des vecteurs, des matrices, des applica-tions. . .. De même pour l’ensemble d’arrivé. Ainsi, on peut avoir une fonction qui à un vecteur associe unefonction.Définition 4.2 Égalité entre applications. Soit E, F deux ensembles et f, g deux applications de E dans F.On dit que f et g sont égales si et seulement six E, fx = gxDans ce cas, on note f = g.Remarque 4.2. Oui, vous savez déjà ce que veut dire l’égalité entre deux fonctions, mais nous sommes là pour êtrerigoureux et définir correctement toutes les notations utilisées!Définition 4.3 Famille. Soit E un ensemble et I un ensemble dont les éléments sont appelés indices. On appellefamille d’éléments de E indexée par I toute application de I dans E.31

Page 38 : CPI12019/2020AlgèbreRemarque 4.3.— Vous remarquez que finalement une famille est une application et une application est une famille. C’est justedeux manières différentes de voir le même objet mathématique, mais aussi deux manières différentes de lenoter : au lieu de noter une famille comme une fonction on notera plutôt xiiI EI.— Nous avons déjà utilisé, de manière purement intuitive, la notion de famille d’ensembles dans le chapitre pré-cédent « Ensembles ». C’est finalement une application de I dans PE.Exemple 4.1. Vous avez déjà rencontré cette notation pour les suites réelles : UnnN. Une suite réelle est donctout simplement une fonction f de N dans R, telle que fn = Un.Encore plus simplement, un famille x1,...,xn d’éléments de E est aussi une application g de J1;nK dans E telleque g1 = x1,...,gn = xn.Définition 4.4 Fonction identité. Soit E un ensemble. On appelle identité de E l’application de E dans Edéfinie parx E, IdEx = xRemarque 4.4. Cette application peut sembler inutile puisqu’elle ne fait rien. Cependant, nous en avons besoin parexemple pour déterminer la dérivée d’une fonction réciproque. De plus, vous la connaissez déjà! Dans R, c’est lafonction dont la courbe représentative le graphe, donc est la droite d’équation y = x.Définition 4.5 Restriction, prolongement. Soit E, F deux ensembles, A E et f FE.— La restriction de f à A est l’application :fA : A→Fx7→fx— Si g est une application de A dans F, on dit que f est un prolongement de g à E si et seulement si fA = g.4.2. CompositionDéfinition 4.6 Composition. Soit E, F, G trois ensembles et f, g deux applications : f FE et g GF. Onappelle composée des applications f et g, l’application de E dans G, notée g◦f, définie par :x E, g◦fx = g fxRemarque 4.5. Afin de ne pas se perdre entre les ensembles d’arrivées, de départs et le sens de la compositionsurtout si on cumule plusieurs compositions, on peut avoir recours à un diagramme commutatif :EFGxfxg fxfg324. Applications

Page 39 : AlgèbreCPI12019/2020Propriété 4.1 Associativité. La composition des applications est associative, c’est-à-dire, soit E, F, G, H quatreensembles et soit f FE, g GF, h HG alorsh◦g◦f = h◦g◦fDémonstration. Soit x E, y = fx, z = gy, t = hz, gf = g ◦f et hg = h ◦g. Nous avons gfx = g ◦fx =gy = z, d’où h◦g◦fx = h◦gfx = hgfx = hz = t. De même, hgy = h◦gy = hgy = hz = t eth◦g ◦fx = hg◦fx = hgy = t. D’où l’égalité quelque soit x E, donc des deux applications.□Remarque 4.6. Cette propriété 4.1, permet d’alléger l’écriture en retirant les parenthèses puisqu’il n’y a pas d’am-bigüité : h◦g◦f = h◦g◦f.Propriété 4.2 Élément neutre de la composition. Soit E, F deux ensembles et f une application de E dans F.AlorsIdF ◦f = f ◦IdE = fOn dit que l’identité est un élément neutre pour la composition.Démonstration. Évident.□4.3. Fonction indicatriceDéfinition 4.7 Fonction indicatrice. Soit E un ensemble et A E. On appelle fonction indicatrice ou fonctioncaractéristique de A, l’application définie sur E par :1A :E→Rx7→1Ax = 1si x A1Ax = 0si x /ARemarque 4.7. La fonction indicatrice nous permet simplement de savoir si un élément appartient à un ensemble oupas.Propriété 4.3. Soit E un ensemble et A, B deux sous-ensembles de E. Alors1A =1B ⇔A = BDémonstration.⇒:A B : Soit x A. Nous avons1Bx =1Ax = 1, donc x B.4. Applications33

Page 40 : CPI12019/2020AlgèbreB A : Même raisonnement.⇐: Évident.Propriété 4.4. Soit E un ensemble et A, B deux sous-ensembles. Alors1.12A =1A2.1A = 11A3.1AB =1A1B4.1AB =1A +1B 1A1BDémonstration.1. Évident du fait que 02 = 0 et 12 = 1.2. Cela provient simplement du fait que 1 0 = 1 et 1 1 = 0 C’est d’ailleurs une astuce souvent utilisée eninformatique pour échanger 1 et 0.3. Si x AB, alors1ABx = 1, mais on a aussi x A et x B, d’où1Ax1Bx = 1×1 = 1. Si x /AB, alors1ABx = 0. Mais si x /A B, alors soit x /A, soit x /B, dans les deux cas, le produit1Ax1Bx est nul.D’où l’égalité des fonctions.4. Trois cas de figure se présentent :— Soit x AB, dans ce cas, x AB et1ABx = 1, mais on a aussi1Ax+1Bx1ABx = 1+11 =1. D’où l’égalité.— Soit x appartient à l’un et un seul des deux ensembles et donc pas à l’intersection. Dans ce cas x ABet1ABx = 1. Mais on a aussi1Ax+1Bx1ABx = 1+00. D’où l’égalité.— Soit x n’appartient à aucun des deux ensembles. Dans ce cas,1ABx = 0 et1Ax+1Bx1ABx =0+00 = 0. D’où l’égalité.D’où l’égalité des fonctions.Exemple 4.2. En se basant sur la propriété 4.3, les fonctions indicatrices permettent de démontrer très simple-ment l’égalité entre deux ensembles. Par exemple : Si A, B et C sont trois parties d’un ensemble E, alors1ABC =1A1BC1ABAC =1AB +1AC 1AB1AC=1A 1B +1C 1B1C=1A1B +1A1C 1A1B1A1C=1A1B +1A1C 1A1B1C=1A1B +1A1C 1A1B1CD’où l’égalité ABC = ABAC.4.4. Image directe et réciproqueDéfinition 4.8 Image directe. Soit E, F deux ensembles, f FE et X E. On appelle image de X par f, lesous-ensemble de F défini par :fX = y F / x X, fx = yRemarque 4.8. L’image de X par f est tout simplement l’ensemble des images des éléments x de X par f.Propriété 4.5. Soit E, F deux ensembles, f FE et A, B deux parties de E.1. Si A B, alors fA fB.2. fAB fAfB.3. fAB = fAfB.344. Applications

Page 41 : AlgèbreCPI12019/2020Démonstration.1. Supposons que A B. Soit y fA, montrons que y fB. Puisque y fA, il existe x Atel que fx = y. Or x A B, donc il existe x B tel que fx = y. D’où y fB.2. Voir correction du TD.3. Voir correction du TD.Définition 4.9 Image réciproque. Soit E, F deux ensembles, f FE et Y F. On appelle image réciproquede Y par f le sous-ensemble de E défini par :f 1Y = x E / fx YRemarque 4.9. L’image réciproque de Y est tout simplement l’ensemble des antécédents qui ont une image dans Y.Donc ce que l’on note pour l’instant f 1 n’est PAS une application, f 1Y est un ensemble contrairement à ce quevous avez peut-être déjà vu et que l’on verra plus tard. . .Propriété 4.6. Soit E, F deux ensembles, f FE et C, D deux parties de F.1. Si C D, alors f 1C f 1D.2. f 1C D = f 1Cf 1D.3. f 1C D = f 1Cf 1D.Démonstration.1. Supposons que C D. Soit x f 1C, montrons que x f 1D. Puisque x f 1C,fx C. Mais comme C D, fx D, ainsi, x f 1D.2. Voir correction du TD.3. Voir correction du TD.4.5. Injections, Surjections, BijectionsDéfinition 4.10 Injection, Surjecction, Bijection. Soit E, F deux ensembles et f FE. On dit que :— f est injectivesi et seulement si x1,x2 E, x1 ̸= x2 ⇒fx1 ̸= fx2si et seulement si x1,x2 E, fx1 = fx2 ⇒x1 = x2— f est surjective si et seulement si y F, x E, fx = y— f est bijectivesi et seulement si f est injective et surjectivesi et seulement si y F, !x E, fx = yRemarque 4.10.— La fonction f est injective signifie que chaque élément de F a au plus un antécédent.— La fonction f est surjective signifie que chaque élément de F a au moins un antécédent.— La fonction f est bijective signifie que chaque élément de F a exactement un antécédent.4. Applications35

Page 42 : CPI12019/2020AlgèbreRemarque 4.11. Une fonction est toujours surjective sur son ensemble image. Ainsi, une fonction injective est tou-jours bijective sur son ensemble image.Exemple 4.3.— L’exemple le plus simple de fonction bijective est tout simplement la fonction identité IdE.— L’injectivité, la surjectivité et donc la bijectivité d’une fonction dépend grandement des ensembles E et F.La fonctionf : R→Rx7→x2n’est pas injective car f1 = f1.n’est pas surjective car y 0 n’a pas d’antécédent.n’est pas bijective car ni injective ni surjective.g = fR+ : R+→Rx7→x2est injective car nous avons restreint l’ensemble des anté-cédent à R+ Nous aurions pu le restreindre à Rou à touteautre partie de Rou R+.n’est pas surjective car y 0 n’a pas d’antécédent.n’est pas bijective car pas surjective.h : R→R+x7→x2n’est pas injective.est surjective car nous avons restreint l’ensemble desimages à R+.n’est pas bijective car pas injective.c : R+→R+x7→x2est injective.est surjective.est bijective car injective et surjective.Propriété 4.7. Soit E, F, G trois ensembles et f FE, g GF1. Si g◦f est injective, alors f est injective.2. si g◦f est surjective alors g est surjective.Démonstration.1. Soit x1 et x2 dans E tels que fx1 = fx2. Montrons que x1 = x2. De l’égalité fx1 =fx2 nous déduisons que g fx1 = g fx2, c’est-à-dire g◦fx1 = g◦fx2. Par injectivité de g◦f, nousdéduisons que x1 = x2.2. Soit z G, montrons qu’il possède un antécédent par g dans F. La surjectivité de g◦f nous donne l’existencede x E, tel que g◦fx = z. En posant y = fx F, nous avons l’existence de y F tel que gy = z, d’où lasurjectivité de g.Définition 4.11 Bijection réciproque. Soit E, F deux ensembles, f FE une application bijective. On appelleapplication réciproque de f l’application de F dans E qui à tout élément de F associe son unique antécédent dansE.f 1 : F→Ey7→x tel que fx = yRemarque 4.12. Soit f une fonction bijective de E dans F.— Soit x E et y = fx son image. Donc par définition, f 1y = x. Ainsi f 1 fx = f 1y = x. Nous avonsmontré que f 1 ◦f = IdE.364. Applications

Page 43 : AlgèbreCPI12019/2020— Soit y F et x son unique antécédent. Donc par définition fx = y et f 1y = x. Ainsi ff 1y= fx = y.Nous avons montré que f ◦f 1 = IdF.Remarque 4.13. Si f est bijective, alors pour tous x E et y F,y = fx ⇔x = f 1ySi f est une fonction de R dans R, cette équivalence signifie que la courbe représentative de f et celle de f 1 sontsymétriques l’une de l’autre par rapport à la droite d’équation y = x première bissectrice.Propriété 4.8. Soit E, F deux ensembles et f FE.La fonction f est bijective si et seulement si il existe g EF telle que f ◦g = IdF et g◦f = IdE.Dans ce cas, la fonction g est égale à la réciproque de f.Démonstration. Condition nécessaire : Cela vient tout simplement de la définition de la réciproque f 1 qui vérifief ◦f 1 = IdF et f 1 ◦f = IdE. On pose alors g = f 1.Condition suffisante : Nous avons f ◦g = IdF or IdF est surjective, donc d’après la propriété 4.7, f est surjective.De même, g◦f = IdE est injective donc f est injective. En conclusion, f est bijective.Puisque f est bijective, elle possède une réciproque f 1. En composant à gauche par f 1 l’égalité f ◦g = IdF,nous obtenons g = IdE ◦g = f 1 ◦f◦g = f 1 ◦ f ◦g = f 1 ◦IdF = f 1. La réciproque est donc l’unique fonctionvérifiant les deux égalités et elle est unique, au cas où nous ayons pas assez insisté là-dessus.□Propriété 4.9. Soit E, F et G trois ensembles, et f FE, g GF deux fonctions.1. Si f et g sont injectives alors g◦f est injective.2. Si f et g sont surjectives alors g◦f est surjective.3. Si f et g sont bijectives alors g◦f est bijective. Dans ce cas, g◦f1 = f 1 ◦g1Démonstration.1. Soit x1 et x2 deux éléments de E tels que g◦fx1 = g◦fx2. Par injectivité de g, nous avonsdonc fx1 = fx2. Par injectivité de f, nous en déduisons que x1 = x2. Donc g◦f est injective.2. Soit z G. Par surjectivité de g, il existe y F tel que gy = z. Par surjectivité de f, il existe x E tel quefx = y. Finalement, nous avons g◦fx = z, d’où la surjectivité de g◦f.3. La bijectivité de g◦f est immédiate à partir des points précédents. Pour le second point :f 1 ◦g1◦g◦f =f 1 ◦g1 ◦g ◦f = f 1 ◦f = IdE. De même, g◦f ◦f 1 ◦g1= g ◦f ◦f 1 ◦g1 = g ◦g1 = IdF. Doncd’après la propriété 4.8, nous avons bien g◦f1 = f 1 ◦g1.Propriété 4.10 Réciproque et image réciproque. Soit E, F deux ensembles, f FE bijective et B F. Alors :f ←B = f 1Boù l’on note f ←B l’image réciproque de B par f et f 1B l’image directe de B par f 1.4. Applications37

Page 44 : CPI12019/2020AlgèbreRemarque 4.14. Avant de démontrer cette propriété, arrêtons nous un instant afin de bien comprendre ce qui est écrit.D’abord nous avons déjà vu que si A est un ensemble, alors on note fA l’ensemble des images des éléments de Apar f, c’est ce que l’on appelle l’image directe de A par f. Ainsi, il est normal de noter l’image directe de B par f 1,f 1B.Ensuite, nous avons défini pour une partie B de F son image réciproque par f, comme étant l’ensemble des antécédentss’ils existent des éléments de B. Nous avons noté cet ensemble f 1B.Vous remarquez que nous avons la même notation pour deux choses bien distinctes en général, ce qui poseproblème. C’est pour cela que dans le cadre de cette propriété, le second ensemble est noté f ←B. Ce que dit cettepropriété, c’est que lorsque f est bijective, finalement ces deux ensembles sont égaux et il n’y a donc pas d’ambigüitédans la notation.Sachant que l’application f 1 n’est définie que lorsque f est bijective, il n’y a donc jamais ambigüité :— Si f est quelconque, alors f 1B représente l’image réciproque de B par f.— Si f est bijective, alors f 1B représente l’image réciproque de B par f, qui est égale à l’image directe de Bpar f 1.Démonstration. Soit x E :x f 1B ⇔b B / x = f 1b ⇔b B / fx = b⇔fx B ⇔x f ←BDéfinition 4.12 Involution. Soit E un ensemble et f EE. On dit que f est involutive ou que f est une invo-lution de E lorsque f ◦f = IdE.Dans ce cas, f est bijective et elle est sa propre réciproque : f 1 = f.Exemple 4.4. La conjugaison dans C est une involution de C, les symétries axiales et ponctuelles sont desinvolutions du plan et la fonction inverse : f : R→Rx7→1xest une involution de R.384. Applications

Page 45 : 5. Nombres complexesDans ce chapitre sur les nombres complexes, nous allons partir du principe que vous les avez déjà vu et acquis enterminale. Nous nous contenterons de faire de brefs rappels dans la première partie.5.1. Rappels de TerminaleThéorème 5.1 Et définitions.— L’ensemble des nombres complexes est noté C et contient l’ensemble des réels R ainsi qu’un certain élémenti pour lequel i2 = 1.— Tout nombre complexe z s’écrit d’une et une seule manière sous la forme dite algébrique : z = a+ ib pourcertains a,b R. Le réel a est appelé partie réelle de z et noté Rez, le réel b est appelé partie imaginaire dez et noté Imz.— Les réels sont exactement les nombres complexes de partie imaginaire nulle. Enfin, un nombre complexe departie réelle nulle est appelé un imaginaire pur.Remarque 5.1. L’unicité de la forme algébrique d’un nombre complexe est utilisée fréquemment pour faire desidentifications. Nous avons z = a+ib = z′ = a′ +ib′ ⇔a = a′ et b = b′. Ainsi une égalité sur des nombres complexesest ramenée à deux égalités sur les réels.Théorème 5.2 Et définitions. L’ensemble C est muni de deux opérations d’addition et de multiplication qui gé-néralisent celles que nous connaissons sur R. Précisément, pour tout z,z′ C :— z+z′ = Rez+Rez′+iImz+Imz′— zz′ = RezRez′ImzImz′+iRezImz′+ImzRez′D’où :— Rez+z′ = Rez+Rez′— Imz+z′ = Imz+Imz′— Rezz′ = RezRez′ImzImz′— Imzz′ = RezImz′+ImzRez′Enfin, pour tout z = x+iy Cavec x,y R : 1z =1x+iy = xiyx2+y2 .Définition 5.1 Affixe et image. On munit le plan d’un repère orthonormal directO;→i ;→j.— Pour tout z = x + iy C avec x,y R, le point M du plan de coordonnées x;y est appelé l’image de ztandis que z est appelé l’affixe de M. On dit aussi que z est l’affixe du vecteur du plan de coordonnées x;y.— Règles de calcul sur les affixes— Pour tout vecteur →u et →v du plan d’affixes respectifs u et v et pour tout λ,µ R, le vecteur λ→u +µ→va pour affixe λu+µv.— Pour tout point A et B du plan d’affixes respectifs a et b, le vecteur →AB a pour affixe ba.39

Page 46 : CPI12019/2020AlgèbreDéfinition 5.2 Conjugué, module. Soi z C.— On appelle conjugué de z le nombre complexe z = ReziImz.— On appelle module de z le réel positif ou nul z =pRez2 +Imz2.Remarque 5.2.— Module et valeur absolue coïncident sur R car pour tout x R, x =x2.— De par sa définition, le module z s’interprète comme norme du vecteur d’affixe z. De même, pour tout a,b Cd’images A,B, le module ab est autre que la distance AB. Il en découle que pour tout R 0 :— le cercle de centre A et de rayon R est l’ensemble z C / za = R— le disque fermé de centre A et de rayon R est l’ensemble z C / za R— le disque ouvert de centre A et de rayon R est l’ensemble z C / za RThéorème 5.3 Propriété du conjugué. Pour tout z,z′ C :Rez = z+z2Imz = zz2iz = zz+z′ = z+z′zz′ = z×z′Théorème 5.4 Propriétés du module. Soit z,z′ C :Propriétés algébriques : z = z, zz = z2, zz′ = z×z′ et si z′ ̸= 0, zz′ = zz′. Enfin, z = 0 ⇔z = 0.Propriétés géométriques : Rez z et Imz z.Inégalités triangulaires : z+z′ z+z′ et zz′ z±z′ z+z′.Théorème 5.5. Soit z C.— z R ⇔Imz = 0 ⇔z = z.— z iR ⇔Rez = 0 ⇔z = z.5.2. Exponentielle complexe5.2.1. Groupe U des nombres complexes de module 1Définition 5.3 Ensemble U. On note U l’ensemble des nombres complexes de module 1, c’est-à-direU = z C / z = 1L’ensemble U est représenté par le cercle trigonométrique de centre O et de rayon 1.405. Nombres complexes

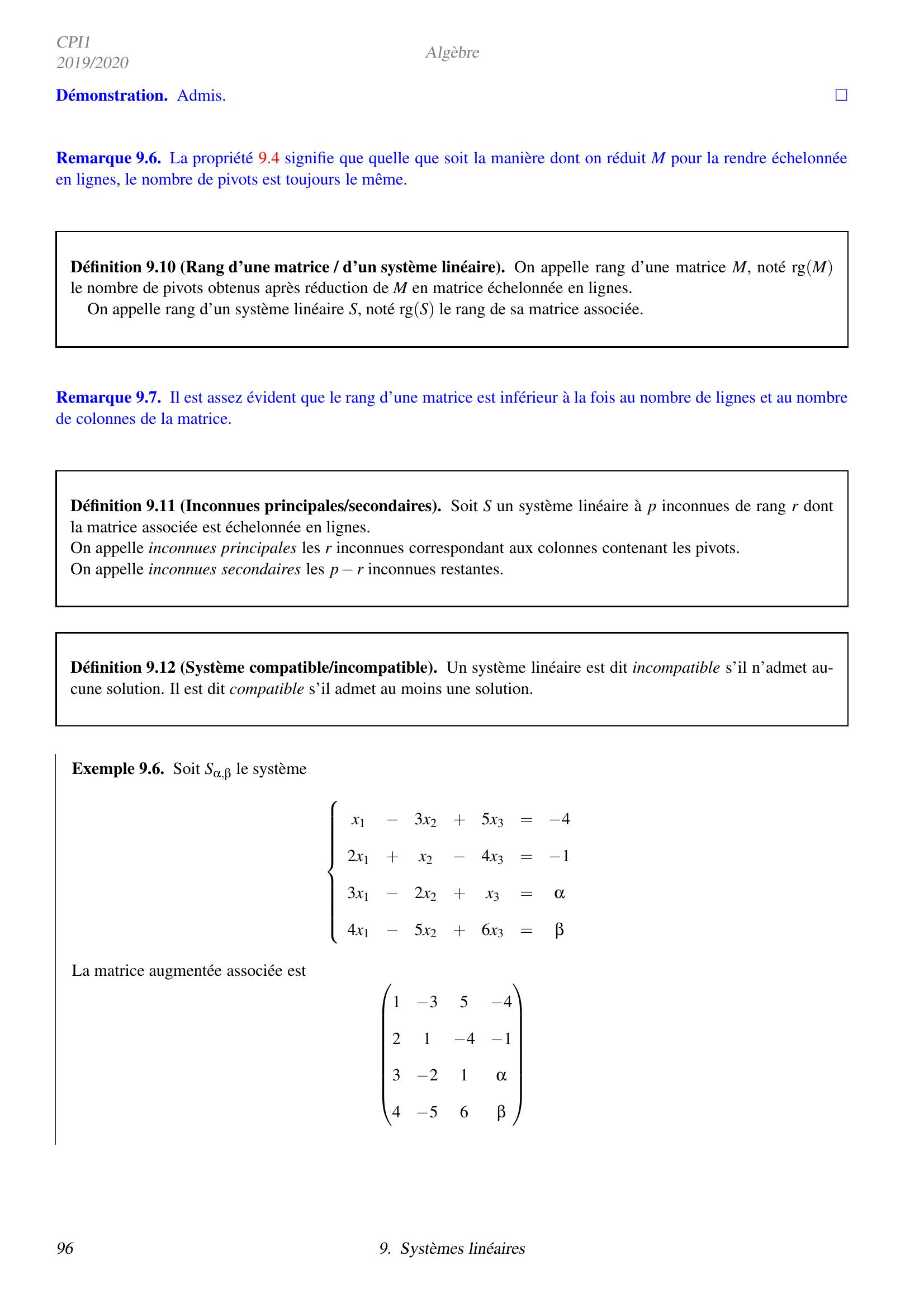

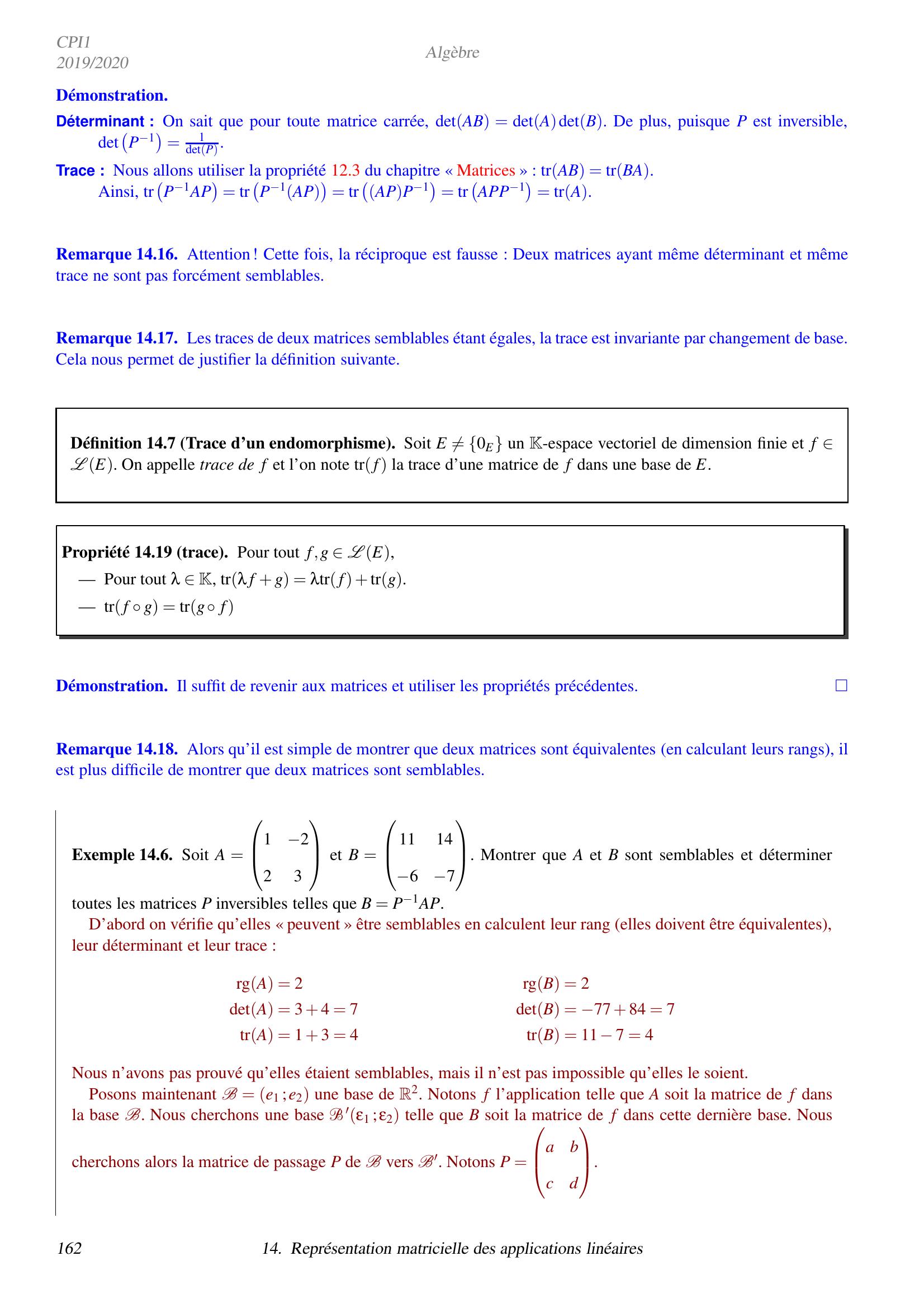

Page 47 : AlgèbreCPI12019/2020Propriété 5.1. L’ensemble U est stable par multiplication et par passage à l’inverse. C’est-à-dire quez,z′ U, zz′ Uz U, 1z UDémonstration. zz′ = zz′ = 1×1 = 1 et1z = 1z = 11 = 1 0 n’appartient pas à U.□Remarque 5.3. Attention!! La propriété 5.1 parle du produit de deux complexes, mais pas de la somme. Il y a unebonne raison à cela. Un contre-exemple tout bête : z = 1 U et z′ = 1 U, pourtant z+z′ = 0 /U.5.2.2. Exponentielle imaginaireLemme 5.1. Soit a et b deux réels tels que a2+b2 = 1. Il existe un réel non unique θ tel que a = cosθ et b = sinθ.Démonstration. Puisque a2 + b2 = 1, nécessairement 1 a 1 et 1 b 1. En nous appuyant sur le cercletrigonométrique, on remarque qu’il existe un réel α tel que cosα = a. Comme cos2 α + sin2 α = 1, nous avonsb2 = sin2 α. Ainsi on a sinα = b ou sinα = b. Si la première égalité est vraie, on prend θ = α, sinon on prendθ = α. Dans les deux cas, le réel θ construit vérifie les deux égalités mentionnées dans l’énoncé du lemme.□Propriété 5.2. Pour tout complexe z U, il existe un réel θ tel que z = cosθ +isinθ.Démonstration. Soit z = a+ib U avec a et b réels. Par définition de U, a et b vérifient a2 +b2 = 1. Par applicationdu lemme 5.1, il existe θ R tel que a = cosθ et b = sinθ. Ainsi z = cosθ+isinθ.□Propriété 5.3 Réciproque de la propriété 5.2.Tout nombre complexe s’écrivant sous la forme z = cosθ +isinθ avec θ R, appartient à U.Démonstration. C’est évident compte tenu du fait que cos2θ+sin2θ = 1.□Propriété 5.4. Soit la fonction f définie parf : R →Cθ 7→fθ = cosθ +isinθAlorsθ R, fθ = fθ =1fθα,β R, fα fβ = fα+β5. Nombres complexes41